eISSN: 2093-8462 http://jesk.or.kr

Open Access, Peer-reviewed

eISSN: 2093-8462 http://jesk.or.kr

Open Access, Peer-reviewed

Seul Chan Lee

10.5143/JESK.2020.39.6.549 Epub 2021 January 04

Abstract

Objective: We aimed at a better understanding and analyzing the design space of external human-machine interfaces (eHMIs).

Background: Autonomous vehicles are expected to become major components in future transportation system. The eHMIs can be widely utilized to interact with road users instead of drivers. Despite of their potential applicability, a holistic understanding of research method and design features for eHMIs remains limited.

Method: We applied a systematic review method to achieve the research objective. A total of 26 articles were finally included for the review process. The selected articles were analyzed depending on the research questions we elicited.

Results: As a result, we provided the results on design space including design variables and levels.

Conclusion: According to our work, it reveals that different considerations should be integrated for developing and testing eHMIs.

Application: Our work provides insights into the development and design of eHMIs, particularly for both practitioners and researchers to conceptualize, implement, and develop their own eHMIs.

Keywords

Autonomous vehicle External Human-Machine Interface (eHMI) Design space Systematic review

자율주행 자동차는 각종 센서 및 기계 학습 기술을 토대로 하여 운전자의 개입없이 스스로 운전할 수 있는 자동차를 의미하며, 수송, 물류, 서비스 등 다양한 영역에서 차세대 산업의 핵심 기술로 각광받고 있다. 하지만 자율주행 자동차가 완전히 도로 교통 시스템 내에 정착하기 위해 해결되어야 하는 많은 장애물들이 존재하고 있다. 특히 자율주행 시스템의 기술적 완성도와는 별개로 인간공학적 관점에서 접근이 요구되는 자율주행 시스템에 대한 신뢰도 확보(Choi and Ji, 2015), 통제권 전환 이슈(Lee et al., 2020b; Yoon et al., 2019; Yoon and Ji, 2019), 자율주행 차량과 주변 교통 시스템 및 사용자들과의 커뮤니케이션(Hagiya and Nawa, 2020), 자율주행 차량 내 새로운 사용자 경험(Lee et al., 2020a) 등의 다양한 현안들이 존재하고 있다.

도로 위의 다양한 사용자로 대변되는 보행자, 다른 차량의 운전자, 이륜차 운전자 등과 운전자가 의사소통을 실시하기 위한 방안에 대한 것이 대표적인 주제 중 하나라고 볼 수 있다. 일반 주행 환경에서 이러한 의사소통은 운전자에 의해 직접 수행되었다. 예를 들어, 교차로 상황에서 운전자와 보행자 간 수신호를 주고 받는 것, 비상등을 켜서 "고맙다" 혹은 "미안하다" 등의 의사를 다른 운전자에게 전달하는 것 등은 명문화된 법규나 규칙은 아니지만 자연스럽게 운전자가 도로 위 사용자들과 의사소통 하는 사례들로 볼 수 있으며, 다양한 문화권에서 확인되는 현상이다(Lee et al., 2019c). 하지만 자율주행 자동차의 경우에는 이러한 의사소통의 주체가 되는 운전자가 부재하기 때문에 자율주행 자동차 스스로가 해당 의사소통을 수행할 방안이 필요하다. 이에 따라 자율주행 차량이 주변의 교통 주체들과 소통하기 위한 다양한 방식이 제안되고 있는데, 자율주행 차량 외부에 설치되는 방식의 인간-기계 인터페이스(external Human-Machine Interface; eHMI)가 대표적이다. Figure 1은 다양한 자율주행 차량 컨셉에 소개된 다양한 형태의 eHMI 예시이다.

차량주행 환경 내에서 사용자 인터페이스는 주행 안전과 직접적으로 연결되기 때문에, 주행 맥락에 관계 없이 모든 상호작용 과정에서 의사소통 오류 없이 최적의 결과를 낼 수 있어야 한다. 오랜 시간 동안 차량 내 사용자 인터페이스의 평가 연구가 운전자의 주행 안전에 대한 영향력에 초점을 맞추어 실시되어온 까닭이 여기에 있다(Jeon et al., 2015; Large et al., 2016; Lee et al., 2019a; Tippey et al., 2017). 자율주행 맥락에서도 여전히 주행 안전이 최우선시되기 때문에, 자율주행 차량의 사용자 인터페이스에 대한 연구도 동일한 맥락에서 수행되어 왔다(Jeon, 2019; Ko et al., 2019; Ko and Ji, 2018; Kutchek and Jeon, 2019; Lee et al., 2020b; Yoon et al., 2019; Yoon and Ji, 2019). 이는 기존의 차량 인터페이스로 존재하지 않던 자율주행 차량의 eHMI 연구에도 동일하게 적용되어야 하는 원칙이다. 이에 따라 연구자들은 자율주행 차량의 eHMI 개발에 고려되어야 하는 설계 요인에 대한 연구 또한 주행 안전의 관점에서 접근하여 결과를 제시하고자 노력하고 있다. 하지만 eHMI 설계 및 평가에 대한 연구는 아주 초기 단계에 불과하기 때문에 관련된 설계 공간(Design Space)에 대한 이해는 아직까지 높지 않은 실정이다.

따라서 본 연구에서는 체계적 문헌 연구 방식을 통해 인간공학의 관점에서 eHMI를 주제로 발표된 논문들을 분석하여, 자율주행 차량의 eHMI 설계 공간에 대해 분석하는 것을 목적으로 한다. 이를 통해 해당 분야에서 자율주행 차량과 주변 교통 주체들 간의 의사소통을 고려한 eHMI를 개발하기 위하여 인간공학적으로 고려해야 하는 주요한 설계 변수 및 수준에 대한 이해를 제공하고자 한다. 본 연구를 통해 밝히고자 하는 구체적인 연구 질문은 다음과 같다.

RQ1: eHMI 설계 공간에 대한 사용자 평가 연구는 어떠한 방식으로 이루어지는가?

RQ2: eHMI가 사용되는 주요한 주행 맥락은 무엇인가?

RQ3: eHMI는 어떠한 형태로 어디에 설치되는가?

RQ4: eHMI를 통해 제공되는 정보의 유형과 표현 방식은 어떠한가?

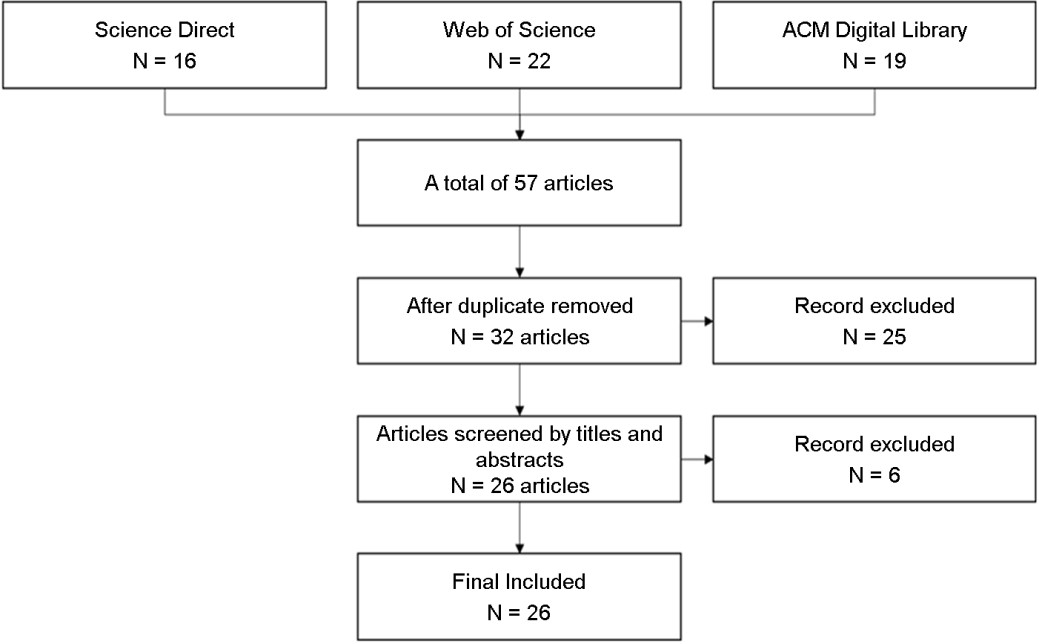

연구 질문에 대한 답을 제공하고 연구 목적을 달성하기 위하여, 본 연구에서는 Preferred Reporting Items for Systematic reviews and Meta-Analysis (PRISMA) 방법론에 기반한 체계적 문헌 연구를 실시하였다(Moher et al., 2009). 해당 방법론은 연구 질문과 관련한 문헌을 수집, 검토, 적격성 확인, 포함의 단계를 통해 연구 질문에 대한 답을 제공하고 연구 목적을 달성하도록 하는 방법론으로써, 문헌 연구 기법을 통해 결과를 도출하고자 하는 많은 연구들에서 활용되고 있다. Figure 2는 해당 방법론을 적용하여 본 연구에서 수행한 문헌 탐색과 포함 과정에 대한 전반적 흐름을 보여주고 있다. 본 연구에서는 세 가지 키워드("external human-machine interface", "external HMI", "eHMI")를 검색 과정에 포함시켰다. 해당 검색 과정은 분야 내 주요 국제 논문 라이브러리인 Science Direct, Web of Science, ACM Digital Library를 통해 실시되었으며, 논문 검색은 2020년 9월에 실시되었다. 검색 과정을 통해 총 57개의 논문이 수집되었으며(Science Direct: 16편, Web of Science: 22편, ACM Digital Library: 19편), 문헌 수집 과정에서는 논문 유형, 출판 년도 등의 성격에 관계없이 모든 문헌이 포함되었다. 이 중에서 중복된 논문들을 제외하고 총 32편이 남았다. 남은 논문들에 대하여 초록을 검토하여 자율주행 차량의 eHMI와 관계 없는 논문들 6편을 제외하고 최종적으로 26편의 논문을 분석 과정에 포함하였다. 연구 질문에 대한 응답을 하기 위해 최종적으로 포함된 논문의 전체 내용에 대한 검토가 진행되었다.

3.1 Research method (related to RQ1)

인간공학 분야에서 많은 실증적 연구들은 제품 및 시스템과 상호작용하는 맥락을 구현하여 해당 맥락 내에서 사용자의 과업 수행도, 신체적 반응, 주관적 평가와 같은 사용자 경험과 관련된 데이터를 수집하는 방식을 활용한다. 이러한 접근 방식을 통해서 사용자들에게 직간접적으로 주어진 상황에 대한 경험을 제공할 수 있기 때문이다. 하지만 주행 안전과 관련한 연구에서는 사고의 위험성 때문에 사용자들을 실제 상황에 놓이게 하는 것은 대단히 어렵다. 이에 따라 철저하게 통제된 주행 코스를 활용하거나(Frison et al., 2019; Li et al., 2017), 실험실 환경에서 시뮬레이션 주행 기법 등을 활용하는 것이 가장 널리 활용되는 방식이다(Lee et al., 2019b; Lee et al., 2019d).

자율주행 맥락에서 eHMI에 대한 사용자 연구는 더욱 제한이 많은 편이다. 기술적 완성이 이루어지지 않은 상황에서 자율주행 차량 맥락을 구현해야 할 뿐만 아니라, eHMI가 활용되는 맥락에서 상호작용의 주요 대상은 차량 외부에 있는 사람이므로 해당 맥락을 구현하기가 어렵기 때문이다. 이러한 조건 내에서 수집된 선행 연구들에서 활용한 방법론들을 정리해보면, 실험실에서의 사용자 평가 연구, 온라인 설문 연구, 실제 필드에서의 연구, 그리고 인터뷰 연구 방법을 활용한 것을 확인할 수 있다(Table 1).

|

Methods |

Materials |

Reference |

|

Lab experiment |

Virtual environments |

(Ackermans et al., 2020;

de Clercq et al., 2019; Kooijman et al., 2019; Lee et al., 2019e) |

|

Recorded videos |

(Dey et al., 2019; Dey et

al., 2020b; Eisma et al., 2020; Faas et

al., 2020a; Faas et al., 2020c) |

|

|

Simulation scenarios |

(Feierle et al., 2020; Rettenmaier et al., 2020a) |

|

|

Mockups or prototypes |

(Rettenmaier et al., 2020b; Schlackl et al., 2020) |

|

|

Online survey |

Images |

(Ackermann et al., 2019;

Bazilinskyy et al., 2019; Dey et al., 2020a; Kim et al., 2020) |

|

Field study |

Fake automated vehicles |

(Faas et al.,

2020b; Moore et al., 2019a; Moore et al., 2019b) |

|

Interview study |

- |

(Ackermann et al., 2019; Schieben et al., 2019) |

|

|

||

실험실 환경에서는 모집된 피험자들에게 eHMI가 활용되는 자율주행 차량이 주행하는 상황을 제공하는 방식을 활용하였다. 상황을 제공하기 위하여 가장 많이 활용 방법 중 하나는 가상 현실(Virtual Reality; VR) 기술을 활용하는 것이다. eHMI가 활용되는 맥락을 VR 환경을 통해 시뮬레이션 상황으로 구현하고 피험자가 Head Mounted Display (HMD)를 착용하여 상황을 간접 경험하는 것이다. 또한 실제 차량의 주행을 촬영한 후, 해당 영상 편집을 통해 가상의 eHMI를 구현하여 동영상을 재생을 통해 간접 경험을 제공하는 방식도 여러 연구에서 활용되었다. 이외에도 가상의 시뮬레이션 시나리오를 구축하거나 목업이나 프로토타입을 활용하는 방식도 확인되었다.

또 다른 접근 방식으로는 온라인 설문 연구가 활용되었다. 실험실 연구에 비해 과업 상황에 대한 재현성은 다소 낮지만, 많은 피험자들로부터 응답을 손쉽게 얻을 수 있다는 이점이 있다. 온라인 설문 양식에 이미지 혹은 짧은 영상을 삽입하여 상황을 제공하고, 해당 상황 내에서 사람들의 응답을 수집하는 방식이다.

실제 도로 상에서 자동차에 eHMI를 구현하고 이를 통해 사용자들의 응답이나 반응을 관찰한 연구도 있다. 해당 연구들에서는 일반 주행 차량이 자율주행 차량처럼 인식되도록 Wizard-of-Oz 방식을 통해 구현하였다. 해당 방식으로 수행된 연구들은 대부분 대학 캠퍼스 내의 도로와 같이 비교적 교통이 적고 안전한 도로에서 연구를 진행하였지만, 이를 통해 사람들로부터 실제에 가까운 경험을 제공할 수 있었다.

이외에도 설계 공간에 대한 탐색적 연구를 위하여 인터뷰 방식의 연구를 수행하기도 하였다. 표적 집단 인터뷰(focus group interview; FGI)가 가장 널리 활용되는 기법 중 하나인데, eHMI의 설계 공간과 관련하여 집단으로 토의하는 과정을 통해 유의미한 인사이트를 도출하고자 하는 것이다.

3.2 Driving context (related to RQ2)

eHMI는 운전자를 대신하여 자율주행 차량이 의사소통을 수행하기 위한 수단이기 때문에 주행 중인 차량이 의사소통이 필요한 맥락에서 사용될 것으로 여겨지고 있다. 현재까지 가장 많은 연구들이 주목한 주행 상황은 자율주행 차량이 보행자와 의사소통 하는 상황으로 확인되었다(Ackermann et al., 2019; Ackermans et al., 2020; Bazilinskyy et al., 2019; de Clercq et al., 2019; Dey et al., 2019; Dey et al., 2020a; Dey et al., 2020b; Eisma et al., 2020; Faas et al., 2020a; Faas et al., 2020b; Kim et al., 2020; Kooijman et al., 2019; Lee et al., 2019e; Moore et al., 2019a; Moore et al., 2019b; Rettenmaier et al., 2020b). 대표적 상황은 보행자가 신호등이 없는 횡단보도에서 대기 중인 상황이다. 해당 상황에서 횡단보도를 지나가는 차량은 속도를 줄이면서 멈추고 보행자가 건널 수 있도록 기다릴 것인지 아니면 속도를 줄이지 않고 그대로 진행할 것인지 여부에 대해 보행자가 판단할 수 있도록, eHMI가 운전자를 대신하여 정보를 제공하여야 한다. 해당 의사소통이 명확하게 이루어지지 않으면 보행자가 차량의 상태를 오인하고 잘못된 판단을 내려 사고가 발생할 가능성이 있기 때문이다. 따라서 분석한 연구들에서는 주어진 상황 내 보행자의 관점에서 횡단보도를 건널 지에 대한 판단 여부, 횡단보도를 건너기에 안전하다고 판단되는 시점 및 시간, eHMI 정보의 의미명확성 및 가독성 등에 대한 평가를 실시하였다.

eHMI는 자율주행 차량과 보행자 사이의 의사소통 뿐만 아니라 자율주행 차량과 다른 차량들과의 의사소통에서도 그 필요성이 제기되고 있다. 모든 상황에서 스스로 운행 할 수 있는 수준까지 자율주행 기술 수준이 높아진다고 하더라도 도로 위의 모든 차량이 한 번에 자율주행으로 바뀌기는 어려울 것이기 때문에, 도로 위에서 자율주행 차량뿐만 아니라 부분 자율주행 차량, 일반 주행 차량 등이 섞여서 운행하게 될 것이다. 따라서 자율주행 차량은 각기 다른 주행 주체의 차량들과 의사소통이 필요하며, 이러한 상황에서의 의사소통을 위한 eHM에 대한 연구가 수행되었다(Ackermans et al., 2020; Feierle et al., 2020; Kim et al., 2020; Schlackl et al., 2020). 예를 들어, Rettenmaier et al. (Rettenmaier et al., 2020a)에서는 골목길과 같이 좁은 차도에서 반대 방향의 차량이 서로 마주하고 있을 때 발생하는 병목 상황에서 eHMI를 통해 의사소통하는 것이 병목 상황을 효율적으로 개선하는지에 대해 확인하였다. Kim et al. (Kim et al., 2020)에서는 자율주행 차량이 다른 차선으로 끼어드는 과정에서 eHMI의 위치와 표현 방식에 따라 끼어드는 차선에 있는 차량 운전자에게 명확하게 의도가 전달되는지 여부에 대해 평가하였다.

3.3 eHMI display type and position (related to RQ3)

앞서 언급한 것처럼, 자율주행 차량을 포함한 모든 차량에 활용되는 사용자 인터페이스는 상호작용 과정에서 오류 없이 정보를 전달하고 의사소통하는 것이 가장 중요한 요소 중 하나이다. 가장 효과적으로 정보를 전달하기 위하여 eHMI를 설계하는 과정에서 고려되어야 하는 요소 중 하나는 상황에 적합한 정보 전달 방식을 선택하는 것이다. 앞서 분석한 서로 다른 주행 상황에서 eHMI를 통해 의사소통을 실시하기 위해 가장 널리 활용되고 있는 정보 전달 형태는 시각적 디스플레이를 활용하는 것이다. 청각적 디스플레이에 기반한 인터페이스의 효과성도 일부 연구들에 의해 확인되고 있지만(Colley et al., 2019; Lee et al., 2019e; Moore et al., 2020), 많은 경우에 청각 디스플레이는 시각 디스플레이와 함께 사용되는 형태로 고려되고 있으며 시각 정보 전달에 입각한 인터페이스가 주된 것으로 간주되고 있다. 따라서 본 연구의 분석 범위를 시각 디스플레이에 기반한 eHMI로 한정하였다.

시각 정보 기반의 eHMI는 크게 세 가지 형태의 정보 전달 방식으로 구분된다. 첫 번째는 시각 정보 디스플레이 기반의 정보 전달이다. 시스템의 상태를 전달하기 위한 시각 정보 디스플레이를 활용하는 것은 전통적으로 널리 활용되어 오는 방식이다. 자율주행 차량 외부의 특정한 위치에 정보를 시각화하여 표현할 수 있는 디스플레이를 설치하여 정보 전달에 활용하는 것이다. 두 번째는 투사형 디스플레이 기반의 정보 전달이다. 투사형 디스플레이의 경우 레이저 등을 활용하여 차량 주변의 바닥 표면에 정보를 투사하여 정보 전달을 행하는 방식이다. 세 번째는 빛(Light)을 활용한 디스플레이 기반의 정보 전달 방식이다. 서로 다른 색의 빛을 사용하여 자율주행 차량의 주행 모드, 주변 인식 상태 등을 표현하여 주변과 의사소통을 실시하는 것이다.

서로 다른 전달 형태의 eHMI를 자율주행 차량의 어느 위치에 설치해야 하는지 여부도 중요한 고려사항 중 하나이다. 근거리 이상으로 떨어진 차량 주변의 사람들에게 정보를 전달해야 하며, 정보의 습득 효율이 달라질 수 있기 때문에 eHMI의 위치가 중요한 설계 요소로 고려되고 있다. eHMI의 위치는 크게 자율주행 차량의 전면/후면 영역, 측면 영역, 지붕 영역, 그리고 투사형 디스플레이를 통한 차량 주변부로 구분되어 진다. 차량의 전면 영역은 주행 상황에서 보행자가 빠르게 정보를 확인할 수 있는 영역으로 간주되기에 가장 일반적인 선택지로 여겨진다. 차량의 전면 영역 내에서도 차량의 그릴 영역이나 전면 윈드실드 영역을 주로 선택하는 것으로 확인되었다. 차량의 측면이나 지붕에 새로운 디스플레이를 설치하는 방식도 가능성을 확인하기 위하여 평가가 이루어지고 있다. 투사형 디스플레이의 경우에는 차량의 전면이나 측면에 정보를 비추는 방식으로 활용되기 때문에, 차량 주변 영역이 디스플레이의 위치라고 생각해 볼 수 있다.

3.4 Information type and format (related to RQ4)

정보의 유형과 표현 방식 또한 효과적인 정보 전달을 위해 중요하게 고려되어야 하는 설계 공간 요인이다. eHMI의 정보 유형은 크게 자율주행 차량의 상태 또는 의도를 전달하는 방식, 상호작용 대상에게 행위를 지시하거나 알려주는 방식, 그리고 행동을 유도하는 정보를 제공하는 방식으로 구분된다. 차량의 상태 또는 의도를 전달하는 방식은 정보를 자율주행 차량의 관점에서 표현하는 방식이다. 차량이 속도를 유지하고 주행할 것인지, 속도를 줄일 것인지, 보행자를 인식하였는지 등에 대한 정보를 표현함으로써 해당 정보를 접한 사람들이 차량의 상태를 이해하고 그에 맞게 행동하기를 기대하는 것이다. 또한 행위를 직접 지시하거나 가능한 행동을 알려주는 방식을 취하기도 한다. 예를 들어, 차량이 보행자를 인식하였고 속도를 줄이고 멈출 것이기 때문에 "건너시오"와 같이 명확하게 상대가 취해도 되는 행동을 명시하는 것이다. 마지막으로 행동을 유도하기 위한 간접적인 정보를 제공하기도 한다. 예를 들어, 횡단보도 패턴을 차량 전면 바닥에 비춤으로써, 사용자들이 횡단보도라는 메타포로부터 차량이 멈출 것이다라는 것을 추측하게 하고 건너가도 된다는 행동을 이끌어내는 것이다.

정보를 표현하는 방식은 eHMI를 통해 전달하는 정보의 유형에 따라 달라진다. 가장 널리 활용되는 방식은 텍스트와 아이콘이나 기호에 기반한 정보 전달이다. 텍스트는 짧은 단어나 문장을 활용하여 정보를 전달하는 방식이며, 아이콘이나 기호는 의미가 담긴 기호화된 도형의 조합을 통해 정보를 전달한다. 텍스트 기반의 디스플레이는 직접적으로 의미를 전달할 수 있다는 장점이 있지만, 텍스트 표현의 용이성이 언어문화권에 따라 다를 수 있다는 단점이 있다(Kacmar, 1991). 아이콘이나 기호의 경우에는 텍스트에 비해 단순하고 압축적으로 정보를 담을 수 있으며, 보다 빠르게 인식하고 디스플레이에 효과적으로 표현할 수 있고, 문화권에 관계 없이 통용될 수 있다는 장점이 있다(Benbasat and Todd, 1993). 하지만 아이콘과 기호에 대한 해석과 이해가 정확하게 이루어지지 않을 수 있다는 한계가 존재한다.

앞서 언급한 빛을 활용하는 디스플레이는 텍스트나 아이콘이나 기호를 활용하지 않고 서로 다른 색을 통해 차량의 상태 정보를 표현한다고 볼 수 있다. 정확한 의미를 포함하고 있는 텍스트, 아이콘, 기호 등을 활용하고 있는 것은 아니지만 사람들이 색깔에 대해 지니고 있는 인식을 활용하여 차량의 상태를 전달하는 방식이다.

본 연구는 자율주행 자동차 eHMI의 설계 공간에 대한 이해를 제공하기 위한 목적으로, 연구 질문을 구성하고 이에 응답하기 위한 체계적 문헌 연구가 실시되었다. 이를 통해 확인된 자율주행 차량 eHMI의 설계 공간은 Table 2와 같이 정리될 수 있다. 시각 정보 디스플레이, 빛을 활용한 디스플레이, 투사형 디스플레이가 주된 방식으로 활용되었으며, 차량 전면부의 라디에이터 그릴과 윈드실드 영역, 지붕 영역, 차량 측면부와 후면부, 혹은 도로 위의 투사가 eHMI 정보 표현의 위치로 확인되었다. 텍스트, 아이콘이나 기호, 그리고 빛을 활용하여 정보를 전달하고자 했으며, 전달하는 정보는 크게 차량의 상태를 표현하는 방식, 보행자나 주변 운전자에게 가능한 행위 를 직접 지시 또는 조언하는 방식, 그리고 횡단보도 그림을 투사하여 행동을 유도하는 방식으로 구분되었다. 설계 공간의 요인들과 수준들에 대해 다음의 사항들을 고려할 필요성이 있다.

|

eHMI display type |

eHMI position |

Information type |

Information format |

|

|

- Radiator grille |

|

|

|

- Visual display |

- Windshield |

- Status information |

- Text |

|

- Light display |

- Roof |

- Instruction (or advice) |

- Icon & Figure |

|

- Projection display |

- Side area |

- Guidance information |

- Light color |

|

|

- Rear area |

|

|

|

|

- Projection on the road |

|

|

첫째, 전체적인 관점에서 설계 공간에 대한 이해를 함으로써, 설계 요인들 간의 관계를 이해할 필요성이 있다. 이는 설계 요인들 간의 조합이 적절하지 않거나 애초에 실현 가능하지 않은 경우가 있기 때문이다. 예를 들어, 투사형 디스플레이의 경우 차량 주변에 정보를 투사하는 형태이기 때문에, 정보의 위치, 유형, 형태의 측면에서 모두 제약사항이 있으며, 빛 디스플레이의 경우에도 서로 다른 빛의 색을 통해 정보를 전달하기 때문에 정보 유형과 형태의 자유도가 높지 않은 편이다.

둘째, eHMI가 사용되는 다양한 주행 상황이 함께 고려되어야 할 필요성이 있다. 특정한 맥락만을 고려하여 설계된 eHMI의 경우 실제 상황에서 마주하게 될 다양한 상황에서 많은 한계점을 드러낼 가능성이 대단히 높다. 본 연구를 통해 확인된 바에 의하면 현재 eHMI 구현을 위해 가장 우선적으로 고려되고 있는 상황은 보행자와의 상호작용 맥락이다. 대부분의 연구에서 자율주행 자동차가 진입하고 있는 상황에서 보행자의 판단에 도움을 주기 위한 측면에 초점을 맞추고 있다. 하지만 실제 상황에서 자율주행 차량은 보행자뿐만 아니라 도로 위의 일반 주행 차량 운전자, 다른 자율주행 차량, 이륜차 등 다양한 주체들과 상호작용 해야 할 가능성이 높다. 상호작용의 주체뿐만 아니라 다양한 주행 상황에 대한 고려도 함께 요구될 것이다. 도로 교통 요소, 도로 환경 등에 의한 상황에 관계 없이 요구되는 상호작용의 목적을 달성할 필요가 있는 것이다.

마지막으로, 다양한 사용자 그룹에 대한 고려가 필수적으로 요구된다. 본 연구를 통해 분석한 연구들을 살펴볼 때, 어린이 등의 교통 약자를 포함한 다양한 사용자 그룹의 관점에서 수행된 연구는 극히 일부에 불과했다. 차량 내 인터페이스의 경우에는 차량을 소유한 운전자가 주된 사용자가 되지만, 자율주행 차량의 eHMI는 도로 위의 수 많은 불특정 다수의 사용자들이 정보 전달과 의사소통의 대상이 된다. 따라서 다양한 사용자 그룹에서의 관점이 반영될 필요성이 있다. 예를 들어, 고령자들의 경우에는 eHMI의 텍스트 가독성이나 아이콘의 문해성의 측면에서 성공적으로 정보를 받아들이고 소통하는데 어려움을 겪을 가능성이 높으며, 어린이들의 경우에는 성인에 비해 키가 작기 때문에 eHMI의 위치에 큰 영향을 받을 수 있다.

설계 공간 내 요인과 수준들 사이의 기술적 결합을 위한 고려사항 이외에 다음의 사항에 대한 고려도 필요할 것으로 보인다. 현재에는 eHMI의 목적성을 기존 차량 내 운전자에 의해 수행되던 의사소통을 대체하는 것에 집중하고 있다. 하지만 eHMI를 통해 전달되는 정보나 수행되는 의사소통이 아닌 다른 목적으로 eHMI가 사용될 수 있는 가능성도 있다. 예를 들어, 도로 교통 안전의 관점에서, 전방 차량에 의해 가려지는 시야로 인한 문제점을 극복하기 위한 용도로 eHMI가 사용될 수 있다. 또한 자율주행으로 운행되는 대중 교통의 경우에는 기존에 버스들이 광고판을 부착하는 것과 마찬가지로, 다양한 광고 정보와 같은 주행과 직접적으로 관련 없는 정보를 표시할 수 있는 가능성도 열려있다. 이러한 목적으로 활용되는 eHMI 같은 경우에는 현재 연구들에서 초점을 맞추고 있는 eHMI의 목적인 보행자와의 일대일 의사소통과는 전혀 다른 목적성을 지니게 되기 때문에, 설계 공간에 대한 초점이 완전히 달라질 가능성이 있다.

후속 연구를 통해 본 연구에서 다루지 못한 다음의 내용들을 고려하면 해당 주제에 대한 더 깊은 통찰을 제공할 수 있을 것이다. 첫째, 우리는 체계적 문헌 연구 기법을 적용하여 문헌을 수집 및 분석하였다. 가장 보편적으로 사용되는 용어인 "eHMI"를 중심으로 해당 과정을 진행하였지만, 해당 용어를 사용하지 않은 연구들이 누락되었을 가능성이 있다. 둘째, 우리는 체계적 문헌 연구 기법을 적용하였지만 메타 분석(meta-review)를 적용하지는 않았다. 메타 분석 기법을 통해 연구흐름에 대한 정량적 수치 결과가 보완된다면 해당 주제에 대한 더 깊은 이해를 제공할 수 있을 것이다. 셋째, 본 연구에서는 자율주행 차량의 eHMI와 관련한 설계 공간에 대하여 전체적인 관점에서 인사이트를 제공하는 것을 목적으로 기존 선행 연구들이 분석되었기 때문에, 개별 설계 변수들의 최적 설계 방식에 대해서는 논의하지 않았다.

References

1. Ackermann, C., Beggiato, M., Schubert, S. and Krems, J.F., An experimental study to investigate design and assessment criteria: What is important for communication between pedestrians and automated vehicles? Applied Ergonomics, 75, 272-282, 2019, https://doi.org/10.1016/j.apergo.2018.11.002

Google Scholar

2. Ackermans, S., Dey, D., Ruijten, P., Cuijpers, R.H. and Pfleging, B., The Effects of Explicit Intention Communication, Conspicuous Sensors, and Pedestrian Attitude in Interactions with Automated Vehicles, Proceedings of the 2020 CHI Conference on Human Factors in Computing Systems, 1-14, 2020, https://doi.org/10.1145/3313831.3376197

Google Scholar

3. Bazilinskyy, P., Dodou, D. and De Winter, J., Survey on eHMI concepts: The effect of text, color, and perspective, Transportation Research Part F: Traffic Psychology and Behaviour, 67, 175-194, 2019, https://doi.org/10.1016/j.trf.2019.10.013

Google Scholar

4. Benbasat, I. and Todd, P., An experimental investigation of interface design alternatives: icon vs. text and direct manipulation vs. menus, International Journal of Man-Machine Studies, 1993, https://doi.org/10.1006/imms.1993.1017

Google Scholar

5. Kacmar, C.J., An experimental comparison of text and icon menu item formats, Human Factors in Information Systems: An Organization Perspective, 27-41 1991.

Google Scholar

6. Choi, J.K. and Ji, Y.G., Investigating the Importance of Trust on Adopting an Autonomous Vehicle, International Journal of Human-Computer Interaction, 31(10), 692-702, 2015, https://doi.org/10.1080/10447318.2015.1070549

Google Scholar

7. Colley, M., Walch, M., Gugenheimer, J. and Rukzio, E., Including People with Impairments from the Start: External Communication of Autonomous Vehicles, Proceedings of the 11th International Conference on Automotive User Interfaces and Interactive Vehicular Applications: Adjunct Proceedings, 307-314, 2019, https://doi.org/10.1145/3349263.3351521

Google Scholar

8. Corporation, N.M., Nissan IDS Concept: Nissan's vision for the future of EVs and autonomous driving, 2015, https:// europe.nissannews.com/en-GB/releases/release-139047

9. Daimler, The Mercedes-Benz F 015 luxury in motion, 2015.

10. Daimler, Autonomous concept car smart vision EQ fortwo: welcome to the future ofcar sharing - Daimler global media site, 2017, http://media.daimler.com/marsMediaSite/en/instance/ko/Autonomous-concept-car-smart-vision-EQ-fortwo-Welcome-to-the-future-of-car-sharing.xhtml?oid=29042725%0A

11. de Clercq, K., Dietrich, A., Núñez Velasco, J.P., de Winter, J. and Happee, R., External Human-Machine Interfaces on Automated Vehicles: Effects on Pedestrian Crossing Decisions. Human Factors, 61(8), 1353-1370, 2019, https://doi.org/10.1177/0018720819836343

Google Scholar

12. Dey, D., Habibovic, A., Pfleging, B., Martens, M. and Terken, J., Color and Animation Preferences for a Light Band EHMI in Interactions Between Automated Vehicles and Pedestrians, Proceedings of the 2020 CHI Conference on Human Factors in Computing Systems, 1-13, 2020a, https://doi.org/10.1145/3313831.3376325

Google Scholar

13. Dey, D., Holländer, K., Berger, M., Eggen, B., Martens, M., Pfleging, B. and Terken, J., Distance-Dependent EHMIs for the Interaction Between Automated Vehicles and Pedestrians, 12th International Conference on Automotive User Interfaces and Interactive Vehicular Applications, 192-204, 2020b, https://doi.org/10.1145/3409120.3410642

Google Scholar

14. Dey, D., Martens, M., Eggen, B. and Terken, J., Pedestrian road-crossing willingness as a function of vehicle automation, external appearance, and driving behaviour, Transportation Research Part F: Traffic Psychology and Behaviour, 65, 191-205, 2019, https:// doi.org/https://doi.org/10.1016/j.trf.2019.07.027

Google Scholar

15. Eisma, Y.B., van Bergen, S., ter Brake, S.M., Hensen, M.T.T., Tempelaar, W.J. and de Winter, J.C.F., External human-machine interfaces: The effect of display location on crossing intentions and eye movements, Information, 11(1), 2020, https://doi.org/10.3390/ info11010013

Google Scholar

16. Faas, S.M., Kao, A.C. and Baumann, M., A Longitudinal Video Study on Communicating Status and Intent for Self-Driving Vehicle - Pedestrian Interaction, Proceedings of the 2020 CHI Conference on Human Factors in Computing Systems, 1-14, 2020a, https://doi.org/10.1145/3313831.3376484

Google Scholar

17. Faas, S.M., Mathis, L.A. and Baumann, M., External HMI for self-driving vehicles: Which information shall be displayed? Transportation Research Part F: Traffic Psychology and Behaviour, 68, 171-186, 2020b, https://doi.org/https://doi.org/10.1016/j.trf.2019.12.009

18. Faas, S.M., Mattes, S., Kao, A.C. and Baumann, M., Efficient Paradigm to Measure Street-Crossing Onset Time of Pedestrians in Video-Based Interactions with Vehicles, Information, 11(7), 2020c, https://doi.org/10.3390/info11070360

Google Scholar

19. Feierle, A., Rettenmaier, M., Zeitlmeir, F. and Bengler, K., Multi-Vehicle Simulation in Urban Automated Driving: Technical Implementation and Added Benefit, Information, 11(5), 2020, https://doi.org/10.3390/info11050272

Google Scholar

20. Frison, A., Wintersberger, P., Schartmüller, C. and Riener, A., The Real T(h)OR: Evaluation of Emergency Take-Over on a Test Track, Proceedings of the 11th International Conference on Automotive User Interfaces and Interactive Vehicular Applications Adjunct Proceedings, 478-482, 2019, https://doi.org/10.1145/3349263.3349602

Google Scholar

21. Hagiya, T. and Nawa, K., Acceptability evaluation of inter-driver interaction system via a driving agent using vehicle-to-vehicle communication, Proceedings of the 11th Augmented Human International Conference, 1-8, 2020, https://doi.org/10.1145/ 3396339.3396404

Google Scholar

22. Jeon, M., Multimodal Displays for Take-over in Level 3 Automated Vehicles while Playing a Game, Extended Abstracts of the 2019 CHI Conference on Human Factors in Computing Systems, 1-6, 2019, https://doi.org/10.1145/3290607.3313056

Google Scholar

23. Jeon, M., Walker, B.N. and Gable, T.M., The effects of social interactions with in-vehicle agents on a driver's anger level, driving performance, situation awareness, and perceived workload, Applied Ergonomics, 50, 185-199, 2015, https://doi.org/10.1016/ j.apergo.2015.03.015

24. Kim, Y.W., Han, J.H., Lee, S.C., Ji, Y.G. and Lee, S.C., Exploring the Effectiveness of External Human-Machine Interfaces on Pedestrians and Drivers. 12th International Conference on Automotive User Interfaces and Interactive Vehicular Applications, 65-68, 2020. https://doi.org/10.1145/3409251.3411725

Google Scholar

25. Ko, S.M. and Ji, Y.G., How we can measure the non-driving-task engagement in automated driving: Comparing flow experience and workload, Applied Ergonomics, 67, 237-245, 2018, https://doi.org/10.1016/j.apergo.2017.10.009

Google Scholar

26. Ko, S., Zhang, Y. and Jeon, M., Modeling the effects of auditory display takeover requests on drivers' behavior in autonomous vehicles. Proceedings of the 11th International Conference on Automotive User Interfaces and Interactive Vehicular Applications Adjunct Proceedings, 392-398, 2019. https://doi.org/10.1145/3349263.3351508

Google Scholar

27. Kooijman, L., Happee, R. and de Winter, J.C.F.F., How Do eHMIs Affect Pedestrians' Crossing Behavior? A Study Using a Head-Mounted Display Combined with a Motion Suit, Information, 10(12), 2019, https://doi.org/10.3390/info10120386

Google Scholar

28. Kutchek, K. and Jeon, M., Takeover and Handover Requests using Non-Speech Auditory Displays in Semi-Automated Vehicles, Extended Abstracts of the 2019 CHI Conference on Human Factors in Computing Systems, LBW0228, 2019, https://doi.org/ 10.1145/3290607.3313078

Google Scholar

29. Large, D.R., Crundall, E., Burnett, G., Harvey, C., Konstantopoulos, P., Factors, H. and Land, J., Driving without wings: the effect of different digital mirror locations on the visual behaviour, performance and opinions of drivers, Applied Ergonomics, 55, 1-17, 2016, https://doi.org/10.1016/j.apergo.2016.02.003

Google Scholar

30. Lee, S.C., Kim, Y.W. and Ji, Y.G., Effects of visual complexity of in-vehicle information display: Age-related differences in visual search task in the driving context, Applied Ergonomics, 81, 102888, 2019a, https://doi.org/10.1016/j.apergo.2019.102888

Google Scholar

31. Lee, S.C., Nadri, C., Sanghavi, H. and Jeon, M., Exploring User Needs and Design Requirements in Fully Automated Vehicles. In Extended Abstracts of the 2020 CHI Conference on Human Factors in Computing Systems Extended Abstracts, 1-9, 2020a, https://doi.org/10.1145/3334480.3382881

Google Scholar

32. Lee, S.C., Sanghavi, H., Ko, S. and Jeon, M., Autonomous driving with an agent: Speech Style and Embodiment. Proceedings of the 11th International Conference on Automotive User Interfaces and Interactive Vehicular Applications Adjunct Proceedings, 209-214, 2019b, https://doi.org/10.1145/3349263.3351515

Google Scholar

33. Lee, S.C., Stojmenova, K., Sodnik, J., Schroeter, R., Shin, J. and Jeon, M., Localization vs. internationalization: Research and Practice on Autonomous Vehicles across Different Cultures, Proceedings of the 11th International Conference on Automotive User Interfaces and Interactive Vehicular Applications Adjunct Proceedings, 7-12, 2019c, https://doi.org/10.1145/3349263.3350760

Google Scholar

34. Lee, S.C., Yoon, S.H. and Ji, Y.G., Modeling task completion time of in-vehicle information systems while driving with keystroke level modeling, International Journal of Industrial Ergonomics, 72, 252-260, 2019d, https://doi.org/10.1016/j.ergon.2019.06.001

Google Scholar

35. Lee, S.C., Yoon, S.H. and Ji, Y.G., Effects of Non-Driving-Related Task Attributes on Takeover Quality in Automated Vehicles, International Journal of Human-Computer Interaction, 1-9, 2020b, https://doi.org/10.1080/10447318.2020.1815361

Google Scholar

36. Lee, Y.M., Madigan, R., Garcia, J., Tomlinson, A., Solernou, A., Romano, R., Markkula, G., Merat, N. and Uttley, J., Understanding the Messages Conveyed by Automated Vehicles, Proceedings of the 11th International Conference on Automotive User Interfaces and Interactive Vehicular Applications, 134-143, 2019e, https://doi.org/10.1145/3342197.3344546

Google Scholar

37. Li, R., Chen, Y.V., Sha, C. and Lu, Z., Effects of interface layout on the usability of In-Vehicle Information Systems and driving safety, Displays, 49, 124-132, 2017, https://doi.org/10.1016/j.displa.2017.07.008

Google Scholar

38. Moher, D., Liberati, A., Tetzlaff, J., Altman, D.G. and PRISMA Group, P., Preferred reporting items for systematic reviews and meta-analyses: The PRISMA statement, PLoS Medicine, 6(7), 2009, https://doi.org/10.1371/journal.pmed.1000097

39. Moore, D., Currano, R. and Sirkin, D., Sound Decisions: How Synthetic Motor Sounds Improve Autonomous Vehicle-Pedestrian Interactions, 12th International Conference on Automotive User Interfaces and Interactive Vehicular Applications, 94-103, 2020, https://doi.org/10.1145/3409120.3410667

Google Scholar

40. Moore, D., Currano, R., Strack, G.E. and Sirkin, D., The Case for Implicit External Human-Machine Interfaces for Autonomous Vehicles, Proceedings of the 11th International Conference on Automotive User Interfaces and Interactive Vehicular Applications, 295-307, 2019a, https://doi.org/10.1145/3342197.3345320

Google Scholar

41. Moore, D., Strack, G.E., Currano, R., Sirkin, D., Ella Strack, G. and Sirkin, D., Visualizing Implicit EHMI for Autonomous Vehicles, Proceedings of the 11th International Conference on Automotive User Interfaces and Interactive Vehicular Applications: Adjunct Proceedings, 475-477, 2019b, https://doi.org/10.1145/3349263.3349603

Google Scholar

42. Rettenmaier, M., Albers, D. and Bengler, K., After you?! - Use of external human-machine interfaces in road bottleneck scenarios, Transportation Research Part F: Traffic Psychology and Behaviour, 70, 175-190, 2020a, https://doi.org/10.1016/j.trf.2020.03.004

Google Scholar

43. Rettenmaier, M., Schulze, J. and Bengler, K., How Much Space Is Required? Effect of Distance, Content, and Color on External Human-Machine Interface Size, Information, 11(7), 2020b, https://doi.org/10.3390/info11070346

Google Scholar

44. Schieben, A., Wilbrink, M., Kettwich, C., Madigan, R., Louw, T. and Merat, N., Designing the interaction of automated vehicles with other traffic participants: design considerations based on human needs and expectations, Cognition, Technology, & Work, 21(1), 69-85, 2019, https://doi.org/10.1007/s10111-018-0521-z

Google Scholar

45. Schlackl, D., Weigl, K. and Riener, A., eHMI Visualization on the Entire Car Body: Results of a Comparative Evaluation of Concepts for the Communication between AVs and Manual Drivers, Proceedings of the Conference on Mensch Und Computer, 79-83, 2020, https://doi.org/10.1145/3404983.3410011

Google Scholar

46. Tippey, K.G., Sivaraj, E. and Ferris, T.K., Driving While Interacting With Google Glass: Investigating the Combined Effect of Head-Up Display and Hands-Free Input on Driving Safety and Multitask Performance, Human Factors, 59(4), 671-688, 2017, https:// doi.org/10.1177/0018720817691406

Google Scholar

47. Yoon, S.H. and Ji, Y.G., Non-driving-related tasks, workload, and takeover performance in highly automated driving contexts. Transportation Research Part F: Traffic Psychology and Behaviour, 60, 620-631, 2019, https://doi.org/10.1016/j.trf.2018.11.015

Google Scholar

48. Yoon, S.H., Kim, Y.W. and Ji, Y.G., The effects of takeover request modalities on highly automated car control transitions, Accident Analysis and Prevention, 123, 150-158, 2019, https://doi.org/10.1016/j.aap.2018.11.018

Google Scholar

PIDS App ServiceClick here!