eISSN: 2093-8462 http://jesk.or.kr

Open Access, Peer-reviewed

eISSN: 2093-8462 http://jesk.or.kr

Open Access, Peer-reviewed

Woohyun Cheon

, Kihyo Jung

10.5143/JESK.2021.40.2. Epub 2021 May 05

Abstract

Objective: This study was intended to develop two risk assessment systems that can evaluate OWAS scores and action level with good accuracy and reliability to prevent work-related musculoskeletal disorders (WMSDs).

Background: Since risk assessment methods such as OWAS and REBA are relied on visual observations, their accuracy and reliability might have been in questions. Therefore, computer-aided risk assessment systems are necessary to enhance accuracy and reliability as well as to improve applicability in workplaces.

Method: This study developed vector-based OWAS (V-OWAS) and deep learning-based OWAS (DL-OWAS). V-OWAS (partial automation) asks a user to manually identify the key joint positions from a working picture and automatically calculates OWAS scores and action level. DL-OWAS (high automation) automatically identifies the key positions and determines OWAS scores and action level. To evaluate the performance of the two systems, we used 40 working pictures and compared the results of the two systems with the results of four ergonomic experts with over 10-year experience who did assess based on traditional visual observations.

Results: The two systems showed similar assessment results with those obtained from the ergonomic experts. The agreement percentage of V-OWAS (91.3%) with the experts was slightly better than DL-OWAS (90%). On the other hand, the usability score of DL-OWAS (7 out of 7 point Likert scale) was significantly higher than V-OWAS (5.75) and traditional visual observation (5.25).

Conclusion: V-OWAS had an advantage in accuracy of identifying the key joint positions; but it required more time and efforts over DL-OWAS. DL-OWAS can assess automatically; but its accuracy might be low if some parts of the body are obscured due to some reasons (e.g., obscured by some machine). Therefore, it is recommended to use V-OWAS or DL-OWAS according to the condition of working picture.

Application: The two OWAS systems developed in this study can help industrial practitioners effectively and efficiently assess working posture for preventing WMSDs.

Keywords

OWAS Musculoskeletal disorders Ergonomic risk assessment Deep learning

근골격계질환은 반복적인 동작, 부적절한 작업 자세, 무리한 힘 사용 등으로 인해 근육, 인대, 건(힘줄), 신경 등에 발생하는 직업 관련성 건강장해(예: 직업성요통, 사고성요통, 수근관질환)를 지칭한다. 산업안전보건법에서는 이러한 근골격계질환을 예방하기 위해 사업장이 신설일로부터 1년 이내인 경우, 사업장에 고용노동부 고시(MOEL, 2020)로 공표된 근골격계부담작업(11가지)이 있는 경우, 그리고 근골격계질환자가 발생한 경우 유해요인을 조사하도록 하고 있다. 유해요인조사는 작업장 상황(설비, 작업공정, 작업량, 작업속도 등), 작업조건(작업시간, 작업 자세, 작업 방법 등), 작업과 관련된 근골격계질환 징후와 증상 등에 대하여 유해요인 기본조사, 인간공학적 조사, 근로자 증상조사 등을 실시하는 것을 의미한다.

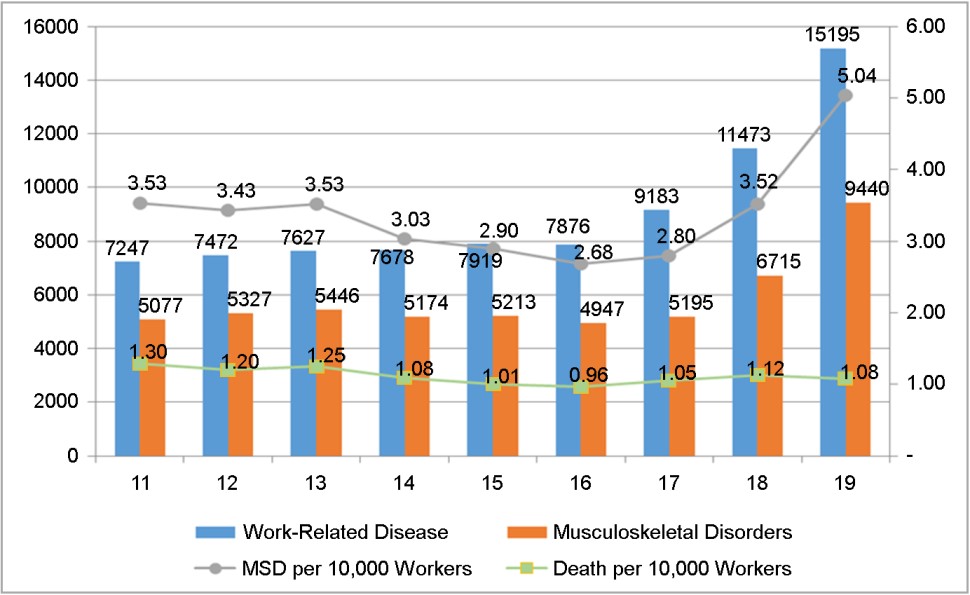

근골격계질환자는 Figure 1에 나타낸 것과 같이 2019년 기준 9,440명으로 업무상질병자(15,195명)의 약 62.1%를 차지하고 있다(KOSHA, 2021). 산업재해 사망 만인율(0/000, 근로자 10,000명당 발생하는 사망자의 비율)은 2011년 이후 최근까지 감소하는 경향을 보이고 있다. 반면, 근골격계질환 만인율(0/000)은 2017년부터 증가추세를 보이고 있으며, 2019년에는 5.040/000로 2011년 이후 가장 높은 것으로 조사되었다(KOSHA, 2011-2019). 이러한 증가 경향성은 최근 들어 산업재해보상보험의 적용대상 확대와 산업재해의 인정기준 완화 등에 기인한 일시적 현상으로 해석될 수도 있으며, 다른 한편으로는 국내 산업현장에 근골격계질환으로 고통받는 근로자가 상당하다고 해석할 수 있다.

직업성 근골격계질환을 효과적으로 예방하기 위해서는 사업주, 근로자, 유해요인 조사자가 사업장의 근골격계질환 유해위험요인을 정확하게 분석하고 그 결과에 근거하여 작업조건 및 환경을 개선하는 것이 필요하다. 이를 위해, 한국산업안전보건공단은 근골격계부담작업 유해요인조사 지침(KOSHA GUIDE H-9-2018, 이하 유해요인조사 지침)을 공표하여 유해요인 기본조사표와 인간공학적 정량평가 도구를 사용하여 유해위험요인을 분석 및 개선할 것을 권장하고 있다. 유해요인조사 지침에는 OWAS (Ovako Working Posture Analysing System), RULA (Rapid Upper Limb Assessment), REBA (Rapid Entire Body Assessment), QEC (Quick Exposure Checklist) 등의 다양한 인간공학적 정량평가 도구가 추천되어 있으나, 사업장의 60~80%는 OWAS, RULA, REBA를 주로 사용하고 있는 것으로 알려지고 있다(Park et al., 2011).

인간공학적 정량평가는 유해요인 조사자가 작업의 부하 수준을 육안에 의존(visual observation)하여 평가하기 때문에 인간공학 비전문가가 평가할 경우 평가 결과의 정확성과 신뢰성에 의문이 제기될 수 있다(Im et al., 2011). 유해요인 조사는 산업안전보건법에 따라 보건관리자가 주로 수행하고 있으나, 사업장의 보건관리자는 대부분(약 70%)이 인간공학기사 등의 유관 자격증이 없는 것으로 알려지고 있다(OSHRI, 2018). 따라서 인간공학 비전문가에 의한 정량평가는 정확성과 신뢰성 문제를 유발할 수 있다(Cheon and Jung, 2020). 이러한 문제를 개선하기 위해 기존 연구들은 측정 장비 및 소프트웨어를 활용하여 작업 자세를 측정 및 평가하는 연구를 활발히 수행하고 있다. Joung et al. (2012), Park et al. (2014), 그리고 Pyo et al. (2019)는 측정 장비(Kinect와 motion capture system)를 활용하여 작업자의 자세를 직접 측정하는 연구를 수행하였다. Park et al. (2005), Cha and Jung (2018), 그리고 Kim (2020)은 작업자 사진에 대한 딥러닝(deep learning)을 통해 작업 자세를 추정하여 작업의 부하를 평가하는 연구를 진행하였다. 측정 장비를 활용한 기존 연구는 측정의 정확성을 혁신적으로 높일 수 있으나 측정 장비를 별도로 준비해야 하고 사업장의 환경(예: 조도, 배경색) 및 공간적 제약 등으로 측정 장비의 설치 및 활용이 제한될 수 있는 한계점이 있다. 한편, 최근 연구된 딥러닝 신경망 모델(Kim, 2020; Li and Xu, 2019)은 작업 사진만 있으면 자세의 최종 부하 수준(action level)를 간편하게 평가할 수 있는 장점이 있으나, 작업 개선을 위해 필요한 신체 부문별 세부 항목(예: 팔 부하, 상체 부하, 하체 부하)을 평가하지 못했거나 세부 항목에 대한 평가 성능이 정량적으로 검증되지 않은 한계점이 있다.

본 연구는 인간공학적 정량평가 도구의 사용성 및 적용성을 높이고 평가 결과의 정확도 및 신뢰도를 향상시키기 위해 작업자의 주요 관절에 대한 벡터(vector) 기반 OWAS 평가 시스템(이하, V-OWAS)과 딥러닝 기반 OWAS 평가 시스템(이하, DL-OWAS)을 개발하였다. V-OWAS (partial automation)는 유해요인 조사자가 작업 사진에 주요 관절의 위치를 수작업으로 지정하면 관절의 벡터를 추출하여 신체 부문별 부하 점수를 계산한다. DL-OWAS (high automation)는 작업 사진을 딥러닝 신경망에 입력하여 자동으로 파악되는 신체 관절의 위치 정보를 활용하여 신체 부문별 부하 점수를 계산한다. 본 연구는 개발된 시스템의 성능을 객관적으로 검증하기 위해 개발된 시스템의 부하 평가 결과와 인간공학 전문가의 평가 결과를 비교 분석하였다. 본 연구에서 개발된 시스템은 사업장에서 인간공학 비전문가도 근골격계질환 자세부하 평가 기법을 조금 더 쉽게 사용할 수 있도록 할 것으로 기대된다.

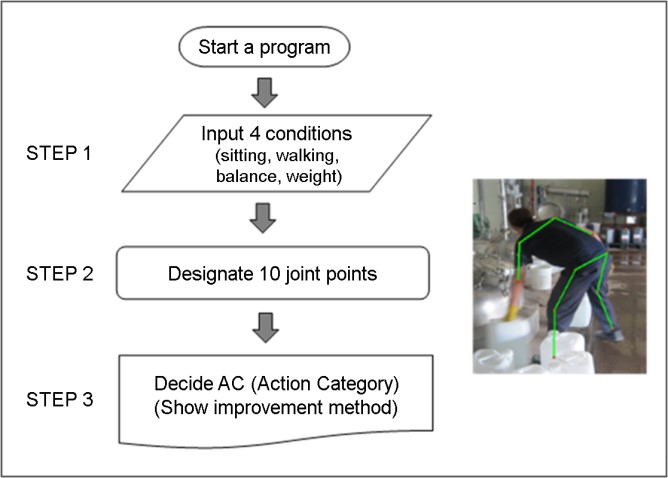

V-OWAS 작업자세 평가 시스템은 파이썬 기반의 비주얼 스튜디오 코드(Visual Studio Code, Microsoft)를 사용하여 개발되었다. V-OWAS는 Figure 2와 같이 3단계 절차를 통해 작업의 부하 수준을 평가할 수 있도록 개발되었다. 첫째 단계는 사진으로 식별하기 어려운 4가지 정보(앉음 여부, 걷기 여부, 신체의 무게중심, 작업물 무게)를 사용자(예: 유해요인 조사자)에게 입력 받는다. 둘째 단계는 분석 대상이 되는 작업 사진을 불러와서 작업자의 주요 관절 기준점(총 10개; 왼팔 2개(어깨점, 팔꿈치), 오른팔 2개, 왼다리 3개(엉덩 관절점, 무릎, 발목), 오른다리 3개)을 사용자가 마우스로 지정한다. 마지막 단계는 각 부문에 대한 자세코드(점수)를 자동으로 찾아 조치 수준(action level)을 결정한다. 또한, 신체 부위별 평가 항목(상체 점수, 상지 점수, 하지 점수, 작업 무게 점수) 중에서 작업 개선을 통해 조치 수준이 한 단계 낮아질 수 있는지 자세코드(점수)를 자체적으로 시뮬레이션 하여 조치 수준이 하락(향상)될 수 있는 경우에는 이를 사용자에게 제시하여 사용자가 개선의 방향에 참고할 수 있게 하였다.

2.1 Score calculation method

2.1.1 Back

허리에 대한 부하는 선 자세(1점), 굽힘(2점), 비틀림(3점), 그리고 굽힘과 비틀림(4점)으로 평가된다. 따라서 허리 점수를 계산하기 위해서는 작업 사진으로부터 상체의 굽힘(bent) 각도와 비틀림(twist) 각도를 계산해야 한다. 상체의 굽힘 각도는 Figure 3a에 예시한 것과 같이 상체와 하지의 수직 기준선 사이의 각도로 정의되었다. 본 연구의 V-OWAS는 작업 사진에서 가슴 중앙점과 허리 중앙점을 연결한 선을 상체로 정의하여 상체 굽힘 각도를 계산하였다.

상체의 비틀림 각도는 Figure 3b에 나타낸 것과 같이 어깨 선(좌우 어깨 관절을 연결한 선)과 엉덩이 선(좌우 엉덩 관절을 연결한 선) 간의 사이 각도로 계산되었다. 어깨 선은 작업 사진에서 좌측 어깨 관절의 중앙점과 우측 어깨 관절의 중앙점을 연결하여 정의되었다. 그리고 엉덩이 선은 좌측 엉덩 관절의 중앙점과 우측 엉덩 관절(hip joint)의 중앙점을 연결하여 설정되었다. V-OWAS는 어깨 선과 엉덩 선 간의 사이 각도를 정량화하여 상체의 비틀림 각도를 계산하였다.

2.1.2 Upper limbs

상지 부하는 두 팔꿈치가 모두 어깨 아래(1점), 한쪽 팔꿈치가 어깨 위(2점), 그리고 두 팔꿈치가 모두 어깨 위(3점)로 평가된다. 본 연구는 Figure 3c에 나타낸 것과 같이 작업 사진에서 팔꿈치 관절의 중앙점이 어깨 관절의 중앙점보다 위에 있는지 여부 판단하여 상지 부하를 계산하였다.

2.1.3 Lower limbs

하지 부하는 7점(1점: 앉음, 2점: 두 다리 선 자세, 3점: 한 다리 선 자세, 4점: 두 무릎 굽힘, 5점: 한 무릎 굽힘, 6점: 무릎 꿇기, 7점: 걷기)으로 평가된다. 먼저, 앉음(1점), 걷기(7점), 무게중심은 작업 사진에서 정확한 식별이 불가능할 수 있어 작업 부하를 평가하는 사용자가 입력하도록 하였다. 선 자세(2점, 3점)와 무릎 굽힘(4점, 5점)을 구분하기 위해서는 Figure 3d와 같이 무릎 굽힘 각도를 계산하는 것이 필요하다. 무릎 굽힘 각도는 윗다리 선(엉덩 관절의 중앙점과 무릎 관절의 중앙점을 연결한 선)이 직선을 이루는 연장선과 아랫다리 선(무릎 관절의 중앙점과 발목 관절의 중앙점을 연결한 선) 간의 사이 각도로 계산되었다. 본 연구는 PATH기법을 참조하여 무릎 굽힘 각도가 35° (Buchholz et al., 1996) 이상이면 무릎 굽힘이 발생한 것으로 판정하였다. 마지막으로, 무릎 꿇기(6점)는 무릎 관절의 중앙점이 발목 관절의 중앙점보다 낮은 위치에 있는지 여부를 확인하여 판정되었다.

2.1.4 Weight

작업 무게는 3점(1점: 10kg 미만, 2점: 10kg 이상 및 20kg 미만, 3점: 20kg 이상)으로 평가된다. 본 연구는 작업 사진으로부터 작업물의 무게를 추정할 수 없어 작업 부하를 평가하는 사용자가 작업 무게를 입력하도록 하였다.

2.1.5 Action level

OWAS는 4가지 측면으로 정량화된 작업 부하를 종합하여 조치 수준을 결정한다. 본 연구의 조치 수준은 기존 연구(Karhu et al., 1977)를 참고하여 4개 수준(AC1: 수용 가능한 자세, AC2: 지속적 관찰 필요, AC3: 가능한 빨리 개선, AC4: 즉시 개선 필요)으로 설정되었다.

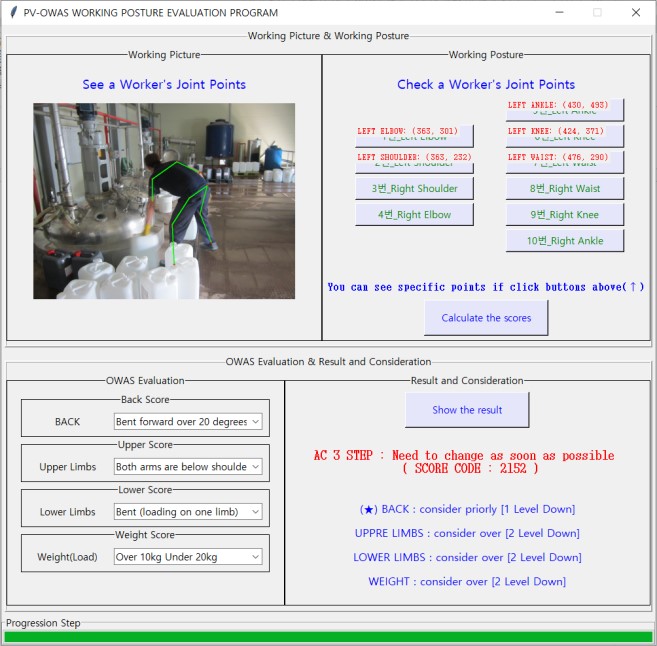

2.2 Implementation of V-OWAS system

V-OWAS 시스템은 Figure 4와 같이 개발되었다. 사용자가 작업자의 주요 관절 10개를 마우스로 선택하면, 작업자의 사진에 선택한 관절을 선으로 연결하여 시각적으로 표시해준다. V-OWAS는 사용자가 선택한 관절의 위치 정보를 이용하여 4가지 OWAS 평가 항목의 점수와 평가 결과에 따른 조치 수준을 결정하여 사용자에게 제시해준다. 또한, V-OWAS는 계산된 점수 및 조치 수준을 이용하여 부하 항목(상체 점수, 상지 점수, 하지 점수, 작업 무게 점수) 중에서 한 수준 낮추었을 때 조치 수준이 1단계 하락(자세 부하 감소)될 수 있는 경우를 자체적으로 시뮬레이션하여 이를 제시함으로써 사용자가 개선의 방향을 설정할 때 참고할 수 있도록 하였다.

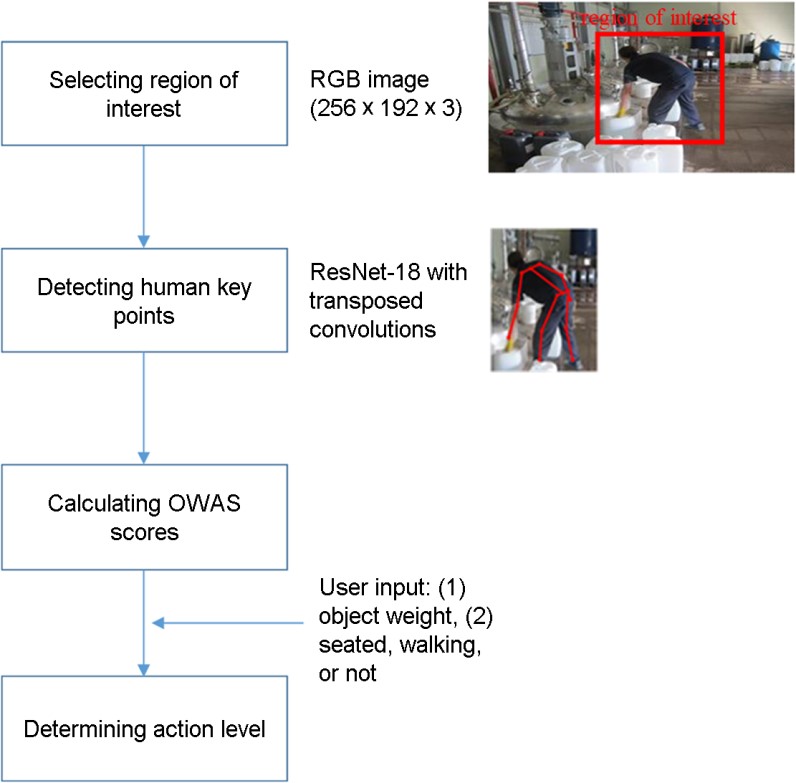

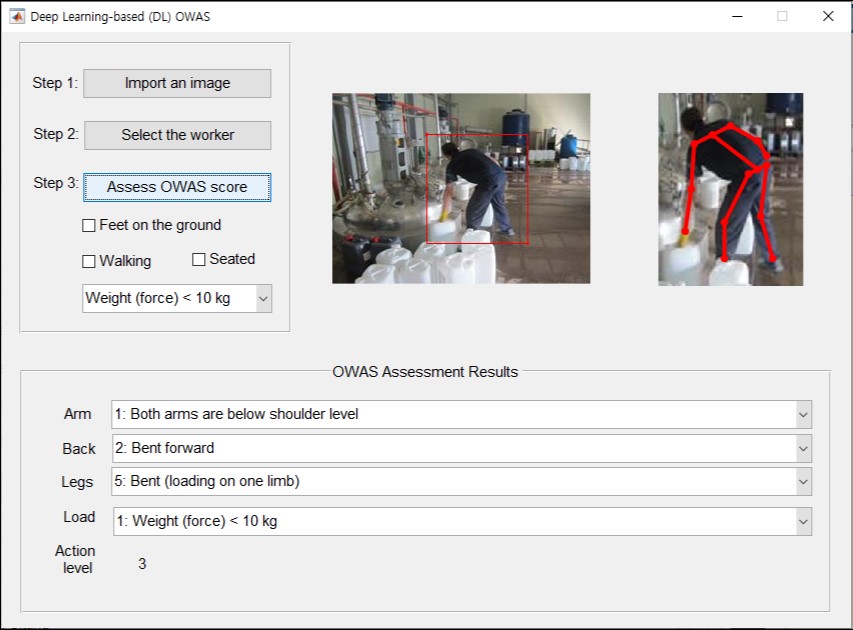

본 연구는 Figure 5에 나타낸 것과 같이 딥러닝을 활용한 4단계 절차를 통해 작업 자세의 부하를 평가하는 시스템을 개발하였다. 첫째 단계는 작업 사진에서 분석 대상 작업자를 포함하는 관심 영역(region of interest)을 선택한다. 둘째 단계는 ResNet-18와 transposed convolution을 연결한 학습망을 사용하여 작업자세 분석에 필요한 작업자의 주요 관절 위치를 추정한다. 셋째 단계는 추정된 주요 위치를 사용하여 OWAS의 부하 항목별 점수를 계산한다. 마지막 단계는 계산된 부하 항목별 OWAS 점수에 근거하여 조치 수준을 결정한다(상세 계산 방법은 2.1장 참조).

3.1 Landmark estimation based on deep learning

본 연구는 작업자의 인체 주요 위치(예: 어깨점, 팔꿈치, 손)를 추정하기 위해 Figure 6에 나타낸 딥러닝 신경망을 사용하였다. Xiao et al. (2018)은 딥러닝 신경망의 학습과 위치 추정(landmark detection) 성능 향상을 위해 ResNet-18과 transposed convolution을 결합한 신경망을 제안하였다. 일반 신경망(plain network)은 망이 깊어질수록 gradient vanishing과 overfitting 문제로 인해 학습 성능이 저하되는 것으로 알려지고 있다(He et al., 2016). 반면, ResNet-18은 잔여 학습(residual learning)을 통해 일반 신경망이 가지는 학습 한계점을 보완하여 보다 깊은 망을 학습할 수 있게 한다. 본 연구는 Figure 6에 나타낸 것과 같이 5개의 합성곱 집단으로 구성된 딥러닝 신경망을 구성하였다.

ResNet-18은 망이 깊어질수록 입력 이미지의 해상도가 낮아져 인체 주요 위치를 정밀하게 추정하기 어려운 제약이 있다(Xiao et al., 2018). 예를 들면, Figure 6에 나타낸 ResNet-18의 합성곱 마지막 집단의 특징 지도(feature map) 크기는 8×6 픽셀(pixel)에 불과하다. 전치 합성곱(transposed convolution)은 특징 지도의 해상도를 높여(upsampling) ResNet-18의 해상도 저하로 인한 부정확한 위치 추정의 문제를 보완할 수 있다(Xiao et al., 2018). 본 연구는 Figure 6에 나타낸 것과 같이 세 번의 전치 합성곱을 통해 특징 지도의 해상도를 64×48 픽셀로 높여 주도록 설계하였다.

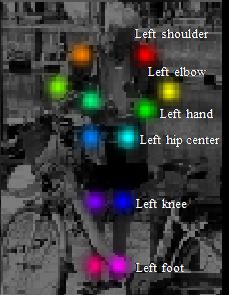

본 연구는 인체 주요 위치에 대한 열지도(heat map)를 추정하도록 신경망을 구성하였다. Tompson et al. (2015)는 입력 이미지에서 인체 주요 위치를 직접 추정할 경우 신경망 학습이 적합하게 진행되지 않아 예측 성능이 저하되는 현상을 발견하였다. 이러한 경향성은 신경망이 특정 위치를 정확하게 추정하도록 학습하는 것이 어렵기 때문인 것으로 해석되고 있다. 반면, Figure 7에 나타낸 것과 같이 인체 주요 위치의 주변에 열지도를 만들어 신경망이 열지도를 예측하도록 하면 예측 성능이 향상되는 것으로 알려지고 있다(Wei et al., 2016). 따라서, 본 연구는 딥러닝 신경망의 마지막 층에 열지도를 예측하도록 망을 구성하였다.

본 연구의 딥러닝에는 OWAS 분석에 필요한 신체 주요 위치를 포함하고 있는 COCO dataset을 사용하였다. COCO dataset은 총 123,287개의 데이터로 구성되며, 이를 무작위로 구분한 learning (118,287개)과 validation (5,000개) dataset을 사용하였다. 작업자세 분석을 위한 신체 주요 위치는 총 12개(왼팔 3개(어깨점, 팔꿈치, 손), 오른팔 3개, 왼다리 3개(엉덩 관절점, 무릎, 발목), 오른다리 3개)로 정의되었다(Figure 8 참고). 본 연구의 딥러닝은 워크스테이션 컴퓨터(STW-811DP, SuSol, Korea)와 Matlab (v2020b, MathWorks, USA)을 사용하여 이루어졌으며, 코드는 Xiao et al. (2018)에 제시된 코드를 기반으로 개발되었다.

3.2 Implementation of DL-OWAS system

본 연구는 Matlab (v2020b, MathWorks, USA)을 활용하여 Figure 8에 나타낸 것과 같이 딥러닝 신경망 기반 OWAS 평가 시스템을 구현하였다. 본 연구의 평가 시스템은 작업 사진에서 분석 대상인 작업자를 추출한 후 딥러닝 신경망을 활용하여 인체의 주요 위치를 추정한다. 그리고 난 후, 추정된 주요 위치를 사용하여 OWAS의 부문별 점수를 계산하고, 이를 종합하여 조치 수준을 결정한다.

4.1 Evaluation methods

본 연구는 개발된 OWAS 평가 시스템(V-OWAS, DL-OWAS)의 정확성 및 사용 편의성을 평가하였다. 이를 위해, 본 연구의 평가에는 인간공학을 전공하고 유해요인조사 등 안전보건분야 경력이 10년 이상인 인간공학 전문가 4명이 참여하였다. 인간공학 전문가는 3가지 방법(전통적 관찰 평가(PC-OWAS), V-OWAS, DL-OWAS)을 적용하여 OWAS 작업 부하를 평가하였다. 평가 대상 작업은 건설업, 제조업, 서비스업 등에서 촬영된 40장의 사진으로 상지, 허리, 하지에 있어서 다양한 자세가 포함되도록 하였다.

정확성은 평가 대상 작업(총 40개)에 대해 V-OWAS와 DL-OWAS의 평가 점수가 PC-OWAS와 일치하는 정도로 분석되었다. 그리고 사용 편의성은 3가지 평가 방법을 적용하여 작업을 평가한 후 평가에 소요된 시간과 평가의 용이성 등을 종합하여 7점 Likert 척도(전혀 그렇지 않다(1점), 그렇지 않다(2점), 약간 그렇지 않다(3점), 보통이다(4점), 약간 그렇다(5점), 그렇다(6점), 매우 그렇다(7점))로 평가되었다.

본 연구의 통계 분석은 유의수준 0.05에서 R (v4.0.2)이 활용하여 이루어졌다. 통계 분석의 독립변수는 OWAS 평가 방법(3수준: PC-OWAS, V-OWAS, DL-OWAS)이었으며, 종속변수는 정확성과 사용 편의성으로 설정되었다. 본 연구의 정확성과 사용 편의성은 정수의 값을 가지므로, 비모수적 검정 방법인 Kruskal-Wallis Test를 적용하여 통계적 유의성을 검정하였다.

4.2 Evaluation results

세 가지 OWAS 평가 방법에 따른 평가 점수의 차이는 Table 1에 나타낸 것과 같이 OWAS 세부 부문 및 조치 수준에 대해 모두 통계적으로 유의하지 않은 것으로 분석되었다. 허리 부문에 대한 평가 점수(평균 ± 표준편차)는 PC-OWAS (1.90±1.081)가 가장 높게 나타났으나, V-OWAS (1.68±1.071) 및 DL-OWAS (1.70±1.018)와 통계적인 차이가 없는 것으로 분석되었다. 또한, 상지 부문에 대한 평가 점수는 PC-OWAS (1.20±0.516), V-OWAS (1.18±0.501), DL-OWAS (1.13±0.463)가 서로 유사하고, 그 차이가 0.07점으로 미미한 것으로 파악되었다. 하지 부문에 대한 평가 점수는 PC-OWAS (3.10±1.809), V-OWAS (3.05±1.797), DL-OWAS (3.15±1.861)가 0.1점으로 차이가 거의 없는 것으로 분석되었다. 무게 부문은 평가 참여자들에게 작업물의 무게를 제시했기 때문에 모든 평가 방법의 점수가 일치하는 것으로 나타났다. 마지막으로, 조치 수준에 대한 평가 점수는 PC-OWAS (1.85±1.099), V-OWAS (1.73±0.987), DL-OWAS (1.83±1.01)가 0.12점으로 큰 차이가 없는 것으로 분석되었다.

|

Part |

Chi-squared value |

DF |

p-value |

|

Back |

1.712 |

2 |

0.425 |

|

Upper limbs |

1.009 |

2 |

0.604 |

|

Lower limbs |

0.108 |

2 |

0.947 |

|

Weight |

0.000 |

2 |

1.000 |

|

Action level |

0.365 |

2 |

0.833 |

V-OWAS의 평가 결과는 인간공학 전문가들이 평가한 PC-OWAS와 91.3% 일치하는 것으로 파악되었다. 또한, DL-OWAS의 평가 결과는 PC-OWAS와 90.0% 동일한 것으로 분석되었다. 마지막으로, 세 가지 방법의 평가 결과가 모두 일치하는 비율은 86.9%로 파악되었다.

사용 편의성 점수는 세 가지 OWAS 평가 방법에 따라 통계적으로 유의한 차이가 있는 것으로 분석되었다((2) = 7.15, p = 0.028). DL-OWAS에 대한 사용 편의성 점수는 7점으로 가장 높은 것으로 파악되었다. 반면, V-OWAS와 PC-OWAS는 5.75점과 5.25점으로 유사한 사용 편의성 점수를 보이는 것으로 분석되었다. 세 가지 OWAS 평가 방법에 대한 사용 편의성 점수의 평균은 6점으로 조사되었으며, 표준편차는 0.90점으로 분석되었다.

본 연구는 한국산업안전보건공단(KOSHA, 2020)에서 홈페이지를 통해 배포 중인 인간공학적 정량평가 도구인 OWAS를 활용하여 자세부하 평가를 보다 정확(신뢰성)하고 쉽게 사용할 수 있도록 2가지 평가 시스템(V-OWAS, DL-OWAS)을 개발하였다. 사업장의 근골격계질환을 감소시키기 위해서는 유해위험요인을 찾아 개선하는 것이 무엇보다도 중요하다. 이를 위해서는 인간공학적 정량평가 도구의 정확성과 신뢰성을 향상시키는 것이 필요하다. 또한, 인간공학을 전공하지 않은 보건관리자도 인간공학적 정량평가를 실시할 수 있도록 사용이 쉽고 편리해야 한다. 본 연구에서 제안된 V-OWAS와 DL-OWAS은 전통적 OWAS 평가 방법(관찰 평가 방법, PC-OWAS)와 유사한 평가 경향을 보였으며, 컴퓨터 기반의 평가가 가능하여 평가자에 관계 없이 일관성 있는 결과를 도출할 수 있는 장점이 있다. 또한, 본 연구의 시스템은 평가 결과의 도출과 점수 판정을 자동화할 수 있어 평가 시간 및 과정을 단축 및 단순화할 수 있어 사용 편의성이 높다.

본 연구에 제안된 2가지 시스템은 서로 상충하는 장점과 단점이 있다. 먼저, 벡터 기반의 OWAS 평가 시스템(V-OWAS)는 평가자가 작업 사진에 신체의 주요 관절 위치를 직접 지정해야 하는 절차가 필요하다. 또한, 평가자가 관절의 위치를 직접 지정할 때 잘못 지정할 경우 평가의 정확도가 떨어질 수 있다. 그러나 이러한 수작업은 작업 사진에서 작업물 및 설비 등으로 작업자의 신체가 가려져도 평가자가 작업 사진의 맥락을 고려하여 신체의 주요 관절을 식별할 수 있는 장점이 되기도 한다. 한편, 딥러닝 기반 OWAS 평가 시스템(DL-OWAS)는 평가자가 작업 사진만 선택하면 딥러닝 신경망이 신체의 주요 관절 위치를 자동으로 추정할 수 있어 사용 편의성이 높다. 그러나 딥러닝 신경망에 의한 자동화는 작업 사진에 작업물 및 설비 등으로 작업자의 신체 부위가 가려질 경우 신체의 주요 관절 위치를 추정하는 성능이 저하되는 단점이 되기도 한다. 따라서 평가 대상이 되는 작업 사진에 따라 V-OWAS(작업자의 신체가 가려진 경우)와 DL-OWAS(작업자의 신체가 확실히 구분이 가능한 경우)를 혼용하는 것이 추천된다.

벡터 및 딥러닝 기반의 OWAS 평가 시스템은 작업 사진으로부터 관절의 2차원 정보(좌표)를 계산하여 작업 부하 점수를 예측하기 때문에 3차원 정보가 필요한 일부 평가 항목에 대해 정확한 평가가 어려운 한계가 있다. 예를 들면, 작업자가 정면(또는 후면)을 바라보고 있는 작업 사진의 경우(Figure 9) 허리에 굴곡이 있어도 2차원 좌표로는 이를 정확하게 계산하기 어렵다. 이러한 한계점을 보완하기 위해서는 작업 사진에서 주요 관절의 3차원 위치를 추정하는 후속 연구가 필요하다. 또한, 작업 사진으로 식별하기 어려워 사용자에게 입력 받은 4가지 정보(앉음, 걷기, 무게중심, 무게)를 최소화할 수 있도록 사물(의자, 공구 등) 유무 및 신체의 무게중심 등을 자동으로 인식하는 알고리즘 개발에 대한 후속연구가 필요하다.

본 연구는 인간공학적 정량평가 도구 중에서 2가지 측면(평가 항목의 단순성, 인간공학 비전공자의 활용성)을 고려하여 OWAS를 연구 대상으로 선정하였다. 첫째, OWAS는 RULA 및 REBA와 함께 다양한 수작업의 작업부하 평가에 적용되고 있으며, RULA 및 REBA와 비교하여 평가의 정확성과 민감도는 상대적으로 낮으나(Kee et al., 2020; Kee, 2020; Kee, 2021) 평가 항목이 단순하며 평가에 소요되는 시간이 짧아 현장 적용성이 우수하다(Wahyudi, 2015). 그로 인해, OWAS는 다양한 업종의 작업부하 평가에 사용이 가능하고 작업부하 평가 방법이 어렵지 않아 상대적으로 짧은 시간 내에 작업자세 평가가 가능하다(Park et al., 2011). 또한, OWAS는 전신 작업의 자세 평가에 적용이 가능하고 특별한 측정 및 분석 도구가 필요하지 않아 산업현장의 활용성이 높다. 둘째, OWAS는 다른 평가 도구보다 평가의 복잡성이 낮아 인간공학을 전공하지 않은 보건관리자도 쉽게 적용할 수 있는 장점이 있다. 산업안전보건법 시행령의 개정(2017. 10. 19.)으로 인간공학기사 이상의 자격을 취득한 사람이 보건관리자의 자격에 포함되었음에도 불구하고 제9차 산업안전보건실태조사에 따르면 사업장의 보건관리자가 인간공학기사 등의 유관 자격증을 보유하고 있는 사업장은 27.2%에 불과하며, 근골격계질환 예방을 위한 작업자세 평가에 인간공학 전문가의 참여는 21.4%로 저조한 실정이다(OSHRI, 2018). 이러한 국내 현실을 감안하여 본 연구는 사업장의 보건관리자 등이 인간공학 비전공자라도 근골격계질환 유해위험요인을 상대적으로 쉽게 분석할 수 있는 OWAS 평가 방법을 기준으로 하였다.

본 연구의 결과가 사업장에 용이하게 적용되기 위해서는 2가지 향후 연구가 필요하다. 첫째, 평가 대상인 작업 사진의 특성(신체 부위의 가려짐 여부)에 따라 V-OWAS와 DL-OWAS를 선택적으로 사용할 수 있도록 두 시스템을 통합하는 것이 필요하다. 둘째, 본 연구는 인간공학적 정량평가 도구 중에서 OWAS를 대상으로 하였다. 그러나 사업장에서는 작업 상황(예: 들기 작업)에 따라 다양한 인간공학적 정량평가 도구를 사용하고 있으므로, 본 연구의 결과를 RULA, REBA, NLE 등으로 확장하는 후속 연구가 필요하다.

References

1. Buchholz, B., Paquet, V., Punnett, L., Lee, D. and Moir, S., PATH: A work sampling-based approach to ergonomic job analysis for construction and other non-repetitive work, Applied Ergonomics, 27(3), 177-187, 1996.

Google Scholar

2. Cha, J.H. and Jung, S.W., A Study on 2D Human Pose Estimation Techniques, Journal of the Korea Information Processing Society, 25(2), 811-812, 2018.

Google Scholar

3. Cheon, W. and Jung, K., Comparison of evaluation results between ergonomic experts and novices for OWAS, RULA, and REBA to improve effectiveness of risk factors assessment. Journal of Korea Society Management and Science, 22(2), 31-28, 2020.

4. He, K., Zhang, X., Ren, S. and Sun, J., Deep Residual Learning for Image Recognition, IEEE Conference on Computer Vision and Pattern Recognition, 2016.

Google Scholar

5. Im, S.J., Choi, S.Y. and Park, D.H., The usability analysis for ergonomic evaluation methods of work-related musculoskeletal disorders, Journal of the Korea Safety Management & Science, 13(2), 83-90, 2011.

Google Scholar

6. Joung, Y.K., Li, Q.R. and Noh, S.D., A Study on the Automated Ergonomic Simulation using Kinect, Society for Computational Design and Engineering, 5, 606-610, 2012.

7. Karhu, O., Kansi, P. and Kuorinka, I., Correcting working postures in industry: A practical method for analysis, Applied Ergonomics, 8(4), 199-201, 1977.

Google Scholar

8. Kee, D.H., An empirical comparison of OWAS, RULA and REBA based on self-reported discomfort, International Journal of Industrial Ergonomics, 26(2), 285-295, 2020.

Google Scholar

9. Kee, D.H., Na, S.H. and Chung, M.K., Comparison of Ovako Working Posture Analysis System, Rapid Upper Limb Assessment, and Rapid Entire Body Assessment based on the maximum holding times, International Journal of Industrial Ergonomics, 77, 2020.

Google Scholar

10. Kee, D.H., Comparison of OWAS, RULA and REBA for assessing potential work-related musculoskeletal disorders, International Journal of Industrial Ergonomics, 83, 2021.

Google Scholar

11. Kim, M., Ergonomic Posture Evaluation based on automatic skeleton recognition and analysis, Journal of the HCI Society of Korea, 15(1), 39-44, 2020.

12. Korea Occupational Safety and Health Agency (KOSHA), The tool of ergonomic evaluation (OWAS), Retrieved April 28, 2020 from https://www.kosha.or.kr /kosha/business/musculoskeletal_c_d.do.

13. Korea Occupational Safety and Health Agency (KOSHA), The status of industrial accident in 2011-2019, from http://www.kosha.or.kr /kosha/data/industrialAccidentStatus.do.

14. Korea Occupational Safety and Health Agency (KOSHA), Guide for risk factors analysts of work-related musculoskeletal Disorders (KOSHA GUIDE H-9-2018), Retrieved December 14, 2018 from http://www.kosha.or.kr/kosha/data/guidanceH.do.

15. Korea Occupational Safety and Health Agency (KOSHA), The analysis of industrial accident in 2019, Retrieved January 21, 2021 from http://www.kosha.or.kr/kosha/data/industrialAccidentStatus.do.

16. Li, L. and Xu, X., A deep learning-based RULA method for working posture assessment, Proceedings of the Human Factors and Ergonomics Society 2019 Annual Meeting, 2019.

Google Scholar

17. Ministry of Employment and Labor (MOEL), Public Notice No. 2020-12.

18. Occupational Safety and Health Research Institute (OSHRI), The 9th survey of occupational safety and health, Retrieved November, 2018 from https://oshri.kosha.or.kr/oshri/researchField/trendsSurvey.do.

19. Park, S.J., Park, J.K. and Choe, J.H., Development of a 2D Posture Measurement System to Evaluate Musculoskeletal Workload, Journal of the Ergonomics Society of Korea, 24(3), 43-52, 2005.

Google Scholar

20. Park, J.H., Lee, I.S., Kee, D.H., Jung, H.S. and Park, J.K., Survey on performance of the risk assessment of musculoskeletal disorders, Journal of the Korean Society of Safety, 26(1), 49-57, 2011.

Google Scholar

21. Park, D.H., Noh, A.N. and Choi, S.Y., A Study on Quantitative Evaluation Method for Risk of Work-related Musculoskeletal Disorders Associated with Back Flexion Posture, Journal of the Korea Safety Management & Science, 16(1), 119-127, 2014.

Google Scholar

22. Pyo, K.Y., Lee, D.M., Cho, H.H. and Kang, K.I., Development of Measurement Method of Musculoskeletal Load for Construction Workers using Wearable Motion Recognition Sensor, The Korea Institute of Building Construction, 19(1), 123-124, 2019.

Google Scholar

23. Tompson, J., Goroshin, R., Jain, A., LeCun, Y. and Bregler, C., Efficient Object Localization Using Convolutional Networks, IEEE Conference on Computer Vision and Pattern Recognition, 2015.

Google Scholar

24. Wahyudi, M.A, Dania, W.A. and Silalahi, R.L., Work Posture Analysis of Manual Material Handling Using OWAS Method, Journal of the Agriculture and Agricultural Science Procedia, 2015, 195-199, 2015.

Google Scholar

25. Wei, S., Ramakrishna, V., Kanade, T. and Sheikh, Y., Convolutional Pose Machines IEEE Conference on Computer Vision and Pattern Recognition, 2016.

Google Scholar

26. Xiao, B., Wu, H. and Wei, Y., Simple Baselines for Human Pose Estimation and Tracking, IEEE Conference on Computer Vision and Pattern Recognition, 2018

Google Scholar

PIDS App ServiceClick here!