eISSN: 2093-8462 http://jesk.or.kr

Open Access, Peer-reviewed

eISSN: 2093-8462 http://jesk.or.kr

Open Access, Peer-reviewed

Soo In Hwang

, Yejin Lee

, Kwang Tae Jung

10.5143/JESK.2025.44.6.925 Epub 2026 January 05

Abstract

Objective: This study aims to propose effective information placement guidelines for automotive windshield head-up displays (HUDs) by examining cognitive response indicators such as perceptual accuracy, reaction time, cognitive efficiency, and signal detection theory metrics.

Background: HUDs can enhance driving safety by presenting information within the driver's field of view. However, cognitive performance may vary depending on the location of the displayed information, and empirical evidence regarding the optimal placement of information in the peripheral visual field remains limited.

Method: Eighteen participants performed a task in which they responded to Stroop stimuli using steering wheel buttons while driving in a simulated environment. The Stroop stimuli appeared in four peripheral locations within the visual field (upper-left, upper-right, lower-left, and lower-right). Accuracy, reaction time, and cognitive efficiency indices (IES, CEI) were analyzed for each location.

Results: Accuracy was higher in the lower visual field, with the highest accuracy observed in the lower-left position and the lowest in the upper-right. Although reaction time did not show a statistically significant difference across locations, responses were generally faster in the lower visual field, with the fastest in the lower-right and the slowest in the upper-right. Cognitive efficiency was highest in the lower-left and lowest in the upper-right. Signal detection analysis indicated that the lower-left position was associated with lower sensitivity and a tendency toward more liberal (risk-taking) decision-making.

Conclusion: The location of information on the HUD produced significant differences in drivers' cognitive performance. The lower-left position demonstrated the highest accuracy and fastest response times, making it most suitable for displaying critical information. Based on overall performance, the recommended order for peripheral information placement is: lower-left → lower-right → upper-left → upper-right.

Application: The findings of this study can inform the development of HUD interface design strategies that account for driver cognitive performance.

Keywords

HUD Peripheral visual field Stroop Information position Cognitive response

운전은 인간의 다양한 인지 자원이 동시에 동원되는 고차원적 복합 인지 과제이다. Endsley (1995)의 상황 인식 이론(situation awareness theory)에 따르면, 운전과 같은 동적 시스템 과업은 '지각–이해–예측'의 연속적 인지 과정을 기반으로 이루어지며, 운전자는 이러한 과정을 통해 도로 상황을 실시간으로 파악하고 시각, 판단, 기억 등 다양한 인지 자원을 통합적으로 활용하여 행동을 조정한다. 특히 운전은 변화하는 도로, 신호 체계, 주변 차량 등 외부 환경으로부터 방대한 양의 시각 정보를 처리해야 하므로 시각 자원(visual resources)에 대한 의존도가 매우 높다. Wickens (2002, 2008)의 다중자원 이론(multiple resource theory)은 인간 정보 처리 체계가 감각양식, 처리단계, 처리코드에 따라 분리된 자원 구조를 갖는다고 설명하며, 실제 운전자는 이러한 제한된 자원을 중심시야(focal vision)와 주변 시야(peripheral vision)에 적절히 분배하며 주행 환경을 탐색하고 판단한다(Vater et al., 2022).

최근 특정 조건이나 전 구간에서 시스템이 운전의 주체가 되어 주변을 인지하고 판단, 조향, 가감속까지 수행하는 자율주행시스템(automated driving system, ADS)과 운전자의 운전을 보조해 주는 운전자지원시스템(advanced driver assistance system, ADAS)의 고도화로 운전자의 안전성과 편의성이 향상되고 있으나, 동시에 차량 내에서 처리해야 할 시각 정보량도 급격히 증가하고 있다(Yae et al., 2017). 자율주행 및 운전자지원 기술의 고도화로 차량 내 시각 정보가 증가하면서 운전자는 주행 중 다양한 비운전 과업과 시각 자극에 노출되고 있다. 이러한 정보 과잉과 부가 자극의 증가는 운전자의 주의 자원을 분산시키고 반응 지연 및 수행 저하를 유발할 수 있으며, 결과적으로 주행 안전에 부정적 영향을 미치는 요인으로 보고된다(Rupp et al., 2016). 실제 연구에서도 운전자의 시선이 전방에서 이탈하거나 부가 과업에 집중할 경우 전방 도로 주시시간이 감소하고 사고 위험이 증가하는 것으로 보고되었다(Metz et al., 2011; Reimer, 2009; Young and Regan, 2003). 이에 국제표준화기구 ISO 15008 (2017)은 차량용 시각 정보가 운전자의 시선을 전방으로 자연스럽게 복귀시킬 수 있도록 설계될 것을 권고하고 있어, 운전자 인지부하를 최소화하는 정보 구조화 및 배치 전략의 중요성이 커지고 있다.

종래의 HDD (head-down display)는 정보를 확인하기 위해 시선을 하향하거나 고개를 숙여야 한다는 한계가 있어 반응 지연과 시야 분산을 야기한다(Ma et al., 2020). 이를 보완하기 위해 등장한 HUD (head-up display)는 운전자의 머리나 시선 이동 없이 전방시야 내에서 필요한 정보를 제공하는 디스플레이 시스템으로, 항공기와 군용 시스템에서 시작해 상용 차량에 널리 적용되고 있다(Enderby and Wood, 1992; Haines et al., 1980).

초기의 HUD는 콤바이너(combiner) 방식으로, 대시보드 위에 설치된 작은 투명 스크린(콤바이너)에 주행 정보를 반사하여 표시하는 형태가 주류였다. 이후 기술이 고도화되면서 표시 영역이 콤바이너를 넘어 차량 전면 유리(windshield) 전체로 확장되었고, 운전자의 시야 전방에 정보를 직접 투사하는 윈드실드 HUD가 등장해 더 넓은 화면과 높은 가독성을 제공하게 되었다. 더 나아가 최근에는 센서와 영상 처리 기술을 기반으로 실제 도로 환경 위에 주행 정보를 정합(align)하여 겹쳐 보여주는 AR-HUD (augmented reality HUD)로 발전하고 있으며, 이를 통해 운전자는 전방시야를 크게 이동하지 않고도 차선, 위험 경고, 내비게이션 안내 등을 현실 배경과 자연스럽게 통합된 형태로 인지할 수 있어 시각적 일체감과 상황 이해도를 한층 강화할 수 있다.

HUD는 HDD 대비 시선 전환 횟수와 시간이 감소하고, 반응 속도, 인지 정확도, 주행 안전성이 향상된다는 연구 결과가 꾸준히 보고되고 있으며(Liu and Wen, 2004; Li et al., 2020), 다양한 운전 상황에서 시선 유지와 반응 성능 향상에도 기여하는 것으로 나타났다(Doshi et al., 2009; Russell et al., 2023).

HUD에서 제시되는 정보의 위치는 운전자의 인지 수행도에 중요한 영향을 미친다. 중심시야는 고해상도 정보 처리와 의미 해석에 유리한 반면, 주변시야는 탐색 및 움직임 감지에는 적절하지만 복잡하거나 정교한 정보 인지에는 한계가 있다(Nakayama and Mackeben, 1989; Wolfe, 1994). 중심시야에 가까울수록 반응시간이 짧아지고 시선 이동이 최소화되며, 전반적 인지 효율성도 높아지는 데 반해(Beck and Park, 2018; Tsimhoni et al., 1999), 시야 중심에서 벗어난 하단 영역에 정보가 배치될 경우 주의 분산과 인지부하가 증가할 수 있다(Ma et al., 2020).

인간이 화면이나 시각 장면을 탐색할 때 보이는 자연적 시각 탐색 패턴(F-패턴, Z-패턴 등)은 사람들이 정보를 무작위로 읽는 것이 아니라 시선의 이동 경로와 주의 분배가 일정한 규칙과 습관에 의해 형성됨을 보여준다. 여기서 F-패턴은 사용자가 화면을 왼쪽 상단에서 가로로 읽다 아래로 내려가며 다시 가로로 훑는 'F'자 시선 흐름이고, Z-패턴은 좌상단→우상단→좌하단→우하단으로 대각선 이동하며 'Z'자 형태로 탐색하는 흐름이다. 이러한 패턴은 곧 정보가 어떤 계층 구조로, 어떤 우선순위와 흐름을 따라 배치되어 있는지가 사용자의 이해와 판단 효율을 크게 좌우한다는 점을 시사하며(NNGroup, 2023), 특히 핵심 정보가 시선이 먼저 도달하는 영역에 적절히 위치하고 보조 정보가 그 흐름을 방해하지 않도록 정렬될 때 탐색 부담이 줄어든다고 설명할 수 있다. 실제로 정보 레이아웃의 설계 방식에 따라 사용자가 목표 정보를 찾는 데 걸리는 반응시간(reaction time)이 단축되거나 지연되고, 정보 식별의 정확도 또한 유의미하게 달라질 수 있으며, 동시에 불필요한 시선 이동이나 재탐색이 증가할수록 인지부하(cognitive load)가 커진다는 실증 연구들이 보고되고 있다(Li et al., 2024; Pečečnik et al., 2023). 이와 같은 연구들은 핵심 정보(primary information)는 중심시야에, 부가 정보(secondary/tertiary information)는 주변시야에 배치하는 것이 바람직하다는 점을 시사한다. 그러나 기존 연구의 대부분은 중심시야와 주변시야 간 단순 비교에 그치며, 주변시야 내부에서 어느 위치(4개 사분면)가 인지적으로 가장 효율적인지에 대한 실증적 근거는 부족한 실정이다.

주변시야 정보 인지 성능은 인간의 시각 처리 특성, 동적 주행 환경 요소, 그리고 HUD 자체의 시각적 특성이 상호작용하여 결정된다. McAnany와 Levine (2007)은 인간 시야를 4개 사분면으로 구분하며 상 · 하 시야는 시각 처리 경로의 차이, 좌 · 우 시야는 대뇌 반구 기능의 비대칭성에 따라 서로 다른 인지 특성을 보인다고 설명하였다. 이러한 생리적, 신경학적 특성은 실제 주행 환경에서 도로, 차량, 그리고 보행자 등 동적 요인과 결합하여 HUD 정보가 위치하는 사분면 별로 상이한 인지 반응을 유발할 가능성을 시사한다. 특히 HUD 정보는 속도, 경고, 내비게이션 등 중요도에 따라 3단계로 구조화되며(Park and Park, 2019), 언어 및 시각적 요소가 혼합된 복합 자극 형태로 제공되기 때문에 주변시야에서의 정보 처리 복잡성은 더욱 증가한다.

이러한 배경을 바탕으로 본 연구에서는 차량 HUD에서 주변시야 내 정보 제시 위치(상좌, 상우, 하좌, 하우)에 따른 운전자의 인지 성능을 비교 분석함으로써, 운전자의 인지 특성을 고려한 HUD 정보 배치 가이드를 제시하고자 하였다.

2.1 Participants

본 실험에는 총 16명(남성 8명, 여성 8명)이 참여하였으며, 이 중 2명(남성 1명, 여성 1명)은 인도 국적의 외국인 참가자였다. 참가자는 온라인 공지를 통해 모집되었으며, 사전 설문을 통해 선정되었다. 평균 연령은 25.6세(SD = 2.5)였으며, 모두 정상 시력 또는 교정된 시력을 가지고 있었다. 모든 참가자는 유효한 운전면허를 보유하고 있었으며, 운전 경력은 2개월에서 10년 사이로 평균 2.4년(SD = 2.8)이었다. 실험에 앞서 모든 참가자는 연구 목적과 절차에 대한 충분한 설명을 듣고, 자발적으로 참여 동의서를 제출하였다.

2.2 Apparatus

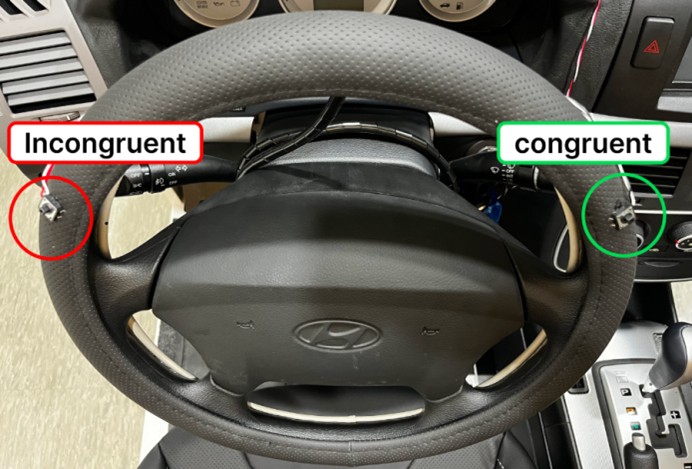

본 실험에서는 실제 차량과 유사한 환경의 운전 시뮬레이터를 사용하였다(Figure 1). 시뮬레이터는 시트, 핸들, 페달, 계기판 등 기본 조작 장치로 구성되었으며, 시트는 참가자의 체형에 맞게 조정할 수 있다. 시뮬레이터는 해상도 1,920×1,080 픽셀의 43인치 디스플레이 3대를 가로로 배열해 총 2,904×569mm의 시야를 제공하였다. 화면에는 도로, 차량, 미러, HUD UI 자극 등 운전 환경이 표시되었으며, 주행 코스는 한국도로교통공단의 실제 운전면허 시험 도로(강남 A · B, 강서 A)를 기반으로 구현하였다. 또한 신호등, 다른 차량 등의 교통 요소를 포함해 실제와 유사한 환경을 재현하였다.

2.3 Task

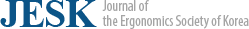

본 연구의 실험 과제는 HUD의 네 위치 중 한 곳에 제시되는 스투룹(Stroop) 자극에 대해 단어 의미와 글자 색이 일치하는지 여부(일치/불일치)를 판단하여 반응하도록 하는 것이었다(Figure 2). 스트룹 자극은 단어 의미와 글자 색 간의 불일치로 인한 간섭 효과를 유발하며, 이를 통해 선택적 주의 및 간섭 억제(억제 통제) 능력을 평가하는 데 사용된다. 이중과업 상황에서 스트룹 간섭에 따른 반응시간 및 정확도 변화는 주의 자원 분배와 인지부하 수준을 민감하게 반영하는 것으로 알려져 있으며, 주행 환경 또는 운전 시뮬레이터에서 2차 과업 부하와 주의 분산 효과를 평가하는 도구로도 광범위하게 활용되어 왔다. 각 자극은 단어 의미와 글자 색상이 일치(congruent)하거나 불일치(incongruent)하도록 조합되었으며, 피실험자는 각 시행(trial)에서 제시된 자극의 일치성을 가능한 빠르고 정확하게 분류하도록 요구되었다. 이와 같은 스트룹 과제는 의미 처리와 색 처리 간 충돌 여부에 따른 인지 간섭을 유발하므로, 두 조건 간 반응시간/정확도 차이를 스트룹 간섭(인지통제 요구) 지표로 해석할 수 있다. 각 자극의 글자 색상은 표준 하이퍼텍스트 마크업 언어(HyperText Markup Language, HTML) 색상 코드(hex code)를 사용해 정의하였으며, 폰트 크기는 32픽셀(px), 굵기는 볼드(bold)로 설정하여 시인성을 확보하였다. 자극은 실제 HUD와 유사한 중첩 효과를 내기 위해 반투명 흰색 박스 안에 제시하였다.

HUD 자극은 일렉트론(Electron) 기반으로 개발되었으며, HTML, 캐스케이딩 스타일 시트(Cascading Style Sheets, CSS), 자바스크립트(JavaScript)로 프론트엔드와 노드(Node.js)로 백엔드를 구성하여 자극의 위치 및 제시 시간 등을 제어하였다. 자극은 운전자 시야에서 약 20° 벗어난 주변시야(peripheral vision)를 기준으로 설정된 네 개의 위치(좌상, 좌하, 우상, 우하)에 제시되었다(Figure 3). 각 자극의 형태는 차량 내부 환경과의 시각적 통합성을 높이기 위해 원근감이 반영된 사다리꼴 형태로 배치하였다.

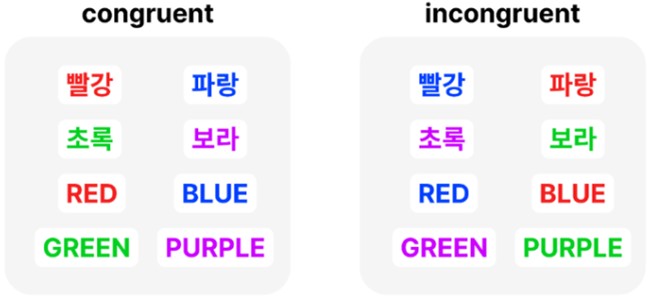

2.4 Response measurement

피실험자의 반응(response)은 핸들에 부착된 버튼으로 측정하였으며(Figure 4), 아두이노(Arduino) 기반 입력 장치를 통해 반응시간을 기록하였다. 오른손 버튼은 일치 조건(congruent)으로 판단한 경우, 왼손 버튼은 불일치 조건(incongruent)으로 판단한 경우에 사용하도록 고정 매핑하였다. 실험 전 참가자에게 양손을 각 버튼 위에 두도록 안내하고, 모든 참가자가 두 조건을 모두 수행하므로 버튼 매핑은 조건 간 비교에 영향을 주지 않음을 명시하였다.

2.5 Experimental design and procedure

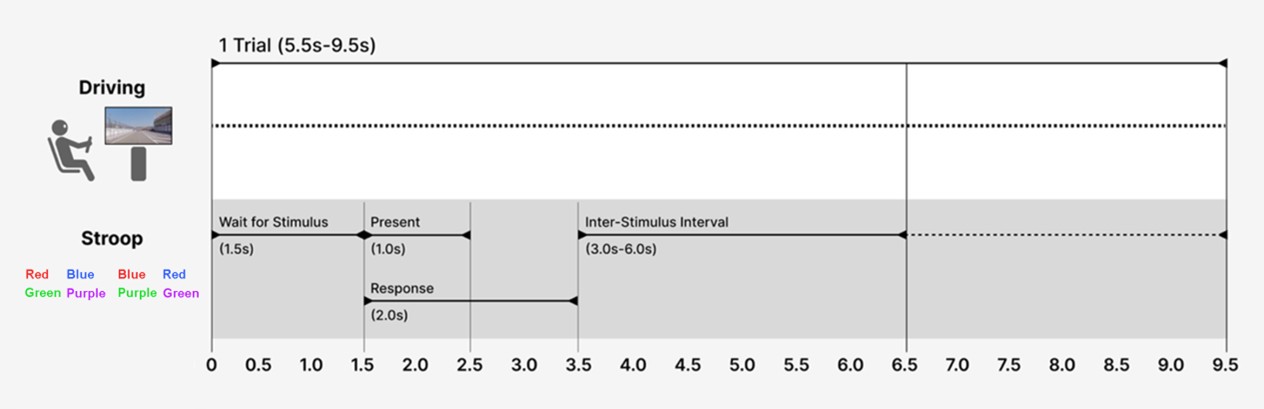

본 연구에서의 독립변수는 HUD에서의 정보 제시 위치(자극 위치: 상좌, 상우, 하좌, 하우)로, 실험을 위하여 피험자 내(within-subject) 요인설계를 사용하였다. 즉, 모든 피실험자가 네 위치에서 제공되는 자극을 모두 실험하도록 설계되었다. 실험은 네 개의 위치에서 20회씩, 총 80회의 실험이 시행되었다. 각 실험에서 자극은 약 20° 주변시야에 위치한 네 개 영역 중 하나에 제시되었고, 일치와 불일치 자극은 각 위치 내에서 50:50 비율로 무작위 순서로 혼합되어 총 20회씩 제시되었다. 따라서 피실험자는 위치와 무관하게 매 실험마다 자극의 일치성을 판단해야 했으며, 이 과정에서 발생하는 의미–색상 간 인지 간섭이 주변시야 위치에 따라 어떻게 변화하는지를 관찰하였다. Figure 5는 한번 실험의 진행 순서를 보여주는데, 피실험자가 전체 실험을 완료하는데 걸리는 시간은 최소 416초(6분 56초)에서 최대 608초(10분 8초)가 소요되었다.

본 실험은 다음과 같은 절차로 진행되었다. 실험 전, 피실험자에게는 충분한 수면과 카페인 섭취 자제를 사전 안내하였다. 피실험자는 실험 장소에 도착한 후, 실험 목적 및 절차에 대한 설명을 듣고 서면 동의서를 작성하였다. 이후 운전 시뮬레이터에 익숙해지도록 10분간 적응 운전을 수행하였으며, 이 과정은 초기 멀미 증상을 완화하기 위한 목적을 포함한다. 적응 후에는 사전 설문지를 작성하고, 3분간 휴식을 취한 뒤 본 실험을 수행하였다. 스트룹 과제 수행 중 피실험자는 HUD에 제시되는 단어의 의미와 글자 색상이 일치하는지 여부를 판단하여 오른손(일치) 또는 왼손(불일치) 버튼으로 응답하였다. 모든 위치 조건에서 자극은 동일한 규칙으로 무작위 제시되었으며, 피실험자는 가능한 빠르고 정확하게 반응하도록 안내 받았다. 실험 종료 후에는 사후 설문을 작성하고, 실험을 종료하였다.

2.6 Data analysis

인지 반응 분석은 정확도(accuracy)와 반응시간(reaction time), 인지 효율 지표(Inverse Efficiency Score, IES; Cognitive Efficiency Index, CEI), 신호탐지이론(Signal Detection Theory, SDT)을 활용하였다. 여기서 IES는 반응시간을 정확도로 나눈 값으로, 값이 낮을수록 빠르고 정확한 수행을 의미한다(Bruyer and Brysbaert, 2011; Liesefeld and Janczyk, 2019; Robinson et al., 2021). 그리고 CEI는 정확도와 반응시간을 표준화한 값의 차로, 값이 높을수록 정확하고 빠른 수행을 나타낸다(Christoforou et al., 2015). 신호탐지이론의 지표로는 민감도(d')와 판단 기준(c)을 활용하였는데, 스트룹 자극의 조건을 기준으로 신호와 노이즈를 구분하였다(Table 1). 종합적으로, 피실험자가 자극을 인지할 때, 정확도와 반응시간을 통해 행동적 수행 성능을 분석하고 인지 효율 지표를 통해 인지 자원 분배의 효율성을 평가하며, 신호탐지이론을 통해 내적 판단 전략을 분석하였다.

|

|

Participant response |

||

|

Congruent |

Incongruent |

||

|

Stroop stimulus |

Congruent (Signal, S) |

Hit (H) |

Miss (M) |

|

Incongruent (Noise, N) |

False Alarm (FA) |

Correct Rejection (CR) |

|

데이터 분석은 파이썬(Python) 기반의 주피터 노트북(Jupyter Notebook) 환경에서 수행하였다. 각 특성치 별로 위치 간 차이를 검증하기 위해 분산분석(ANOVA)을 수행하였고, 유의한 결과에 대해서는 사후분석(post-hoc test)을 실시하였다.

3.1 Accuracy by stimulus location

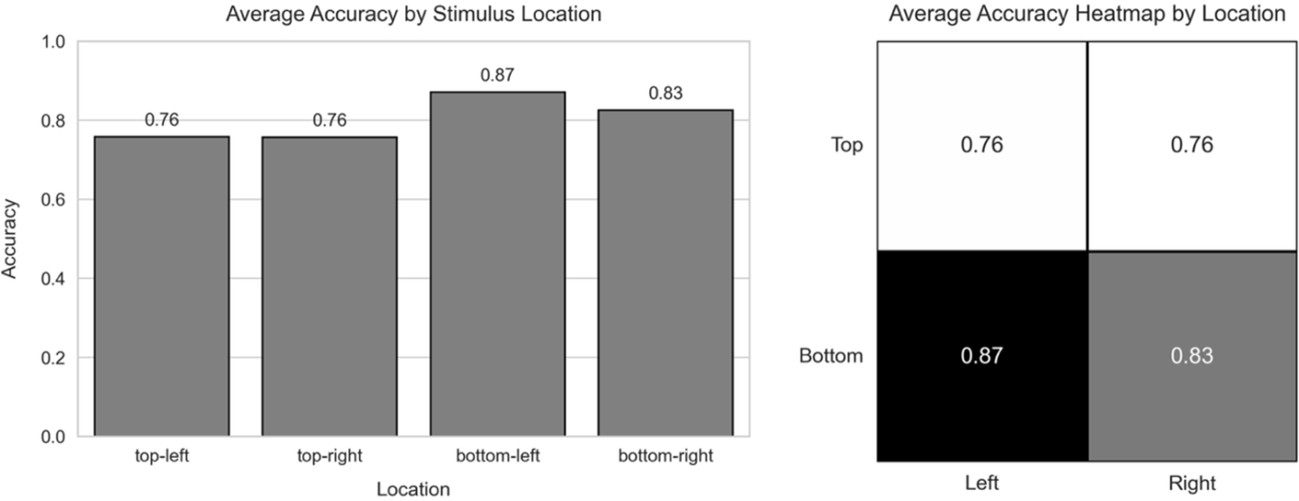

자극 제시 위치에 따른 평균 정확도는 하단 위치가 높은 정확도를 보였으며 그 중 좌하 위치에서 가장 높은 정확도(0.871), 우상 위치에서 가장 낮은 정확도(0.757)를 보였다(Table 2, Figure 6). Table 3의 분산분석(One-way ANOVA) 결과를 보면, 위치에 따른 효과가 유의수준 0.05에서 통계적으로 유의하였고(F=4.35, p=0.01), 사후검정을 수행하여 좌하와 좌상 간의 정확도 차이가 통계적으로 유의한 것을 확인하였다(p = .019).

|

Location |

Accuracy (M ± SD) |

|

Top-left |

0.758±0.429 |

|

Top-right |

0.757±0.430 |

|

Bottom-left |

0.871±0.336 |

|

Bottom-right |

0.825±0.380 |

|

Source |

SS |

DF |

MS |

F |

Sig. |

|

Location |

0.164578 |

3 |

0.054859 |

4.350152 |

0.008364 |

|

Error |

0.643157 |

51 |

0.012611 |

3.2 Reaction time by stimulus location

자극 위치에 따른 평균 반응시간은 하단이 빨랐으며 그 중 우하 위치에서 가장 짧았고, 좌상과 우상 위치에서 가장 길었다(Table 4, Figure 7). 하지만 Table 5의 분산분석(One-way ANOVA) 결과를 보면, 위치에 따른 반응시간의 차이는 유의수준 0.05에서 통계적으로 유의하지 않았다(F = 0.77, p = 0.52).

|

Location |

Reaction time (M ± SD) |

|

Top-left |

1201.691±277.505 |

|

Top-right |

1202.472±302.825 |

|

Bottom-left |

1171.584±292.872 |

|

Bottom-right |

1165.483±290.578 |

|

Source |

SS |

DF |

MS |

F |

Sig. |

|

Location |

15660.02248 |

3 |

5220.007492 |

0.767969 |

0.517286 |

|

Error |

346655.3035 |

51 |

6797.162814 |

3.3 Cognitive efficiency metrics

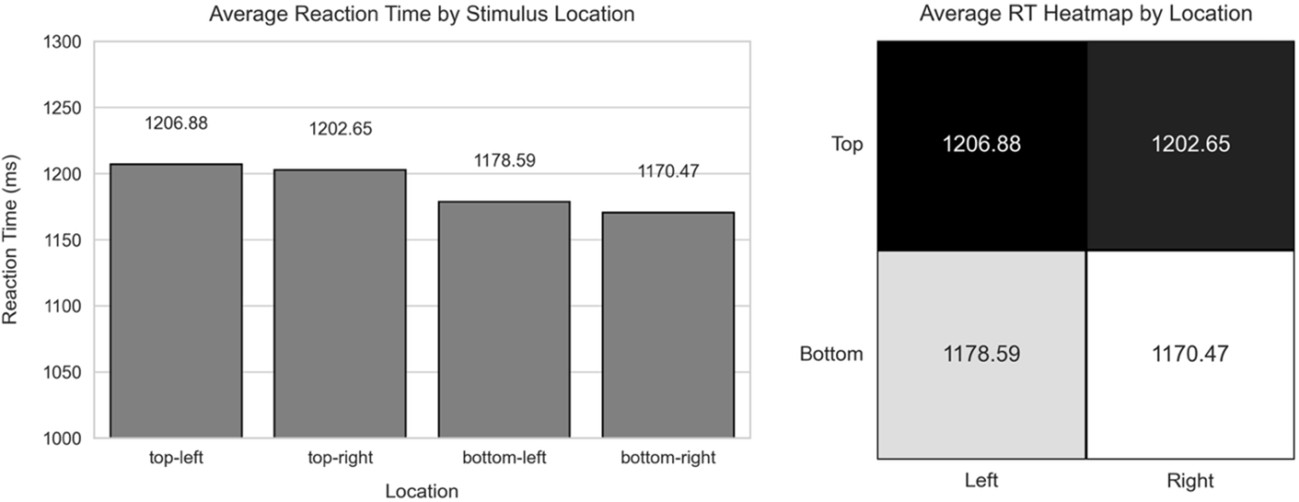

정확도와 반응시간을 활용하여 인지 효율성 척도인 IES와 CEI를 산출하였다. Figure 8을 보면, CEI 기준 효율 순위는 우하 > 좌하 > 우상 > 좌상 순으로 나타났다 그리고 위치별 CEI 차이에 대한 분산분석 결과(Table 6), CEI는 유의수준 0.05에서 위치에 따라 통계적으로 유의한 차이가 확인되었다(F = 5.11, p = .004). 반면 Table 5를 보면, IES는 유의수준 0.05에서 위치에 따라 통계적으로 유의한 차이가 나타나지 않았다(F = 2.17, p = .10).

|

|

Source |

SS |

DF |

MS |

F |

Sig. |

|

CEI |

Location |

1.66E-07 |

3 |

5.55E-08 |

5.109636 |

0.00362 |

|

Error |

5.54E-07 |

51 |

1.09E-08 |

|

|

|

|

IES |

Location |

1.29E+06 |

3 |

429287.9899 |

2.165905 |

0.10341 |

|

Error |

1.01E+07 |

51 |

198202.6224 |

인지 효율 지표의 Stroop 간섭 효과를 검증하기 위한 대응표본 t-검정 결과(Table 7), IES에서는 좌하 위치에서만 유의한 차이가 나타났고(p = .013), CEI에서는 좌하(p = .009)와 우상(p = .024) 위치에서 유의한 차이가 확인되었다. 즉, 스트룹 간섭 발생 시 좌하 및 우상 위치에서 인지 효율이 저하되는 경향을 보였다. 특히 불일치 조건에서 IES는 증가(효율 저하)하고 CEI는 감소(효율 저하)하는 방향으로 나타나, 간섭 효과의 방향이 지표 정의와 일관됨을 확인하였다.

|

Measure |

Location |

t |

p |

Hedges' g |

|

IES |

Top-left |

0.464 |

.648 |

0.110 |

|

Top-right |

1.812 |

.088 |

0.321 |

|

|

Bottom-left |

2.792 |

.013* |

0.574 |

|

|

Bottom-right |

-0.770 |

.452 |

-0.091 |

|

|

CEI |

Top-left |

-0.531 |

.602 |

-0.110 |

|

Top-right |

-2.470 |

.024* |

-0.365 |

|

|

Bottom-left |

-2.945 |

.009** |

-0.550 |

|

|

Bottom-right |

-0.703 |

.491 |

-0.088 |

|

|

Note. *p < .05, **p < .01, ***p < .001 |

||||

3.4 Signal detection theory

신호탐지이론 지표인 민감도(d'), 판단 기준(c), 반응편향(β)은 각각 자극 변별 능력, 의사결정의 보수성/모험성, 그리고 반응 전략의 편향 정도를 나타낸다. d'가 높을수록 신호–노이즈 변별이 우수하며, c가 양수일 경우 보수적(conservative) 판단, 음수일 경우 모험적(liberal) 판단을 의미한다. β는 1보다 크면 보수적 반응편향, 1보다 작으면 모험적 반응편향을 의미한다. 우하 위치에서 d'와 c가 ±∞로 산출된 것은 오류가 관찰되지 않아(FA = 0 또는 Miss = 0) 분모가 0에 가까워지는 신호탐지이론 계산 특성에 따른 결과로, 해당 위치에서 변별 실패 사례가 없었음을 뜻한다.

Table 8은 위치별 민감도와 판단 기준, 반응편향을 보여주며, 우하 위치의 경우 오류가 없었으며 인지할 경우 무응답이었기에 계산된 값이 무한대로 나타났다. 민감도는 상단 위치에서 높고 하단 위치에서 낮게 나타났다. 좌상 위치에서 가장 높은 민감도를 보였으며(d' = 4.4972), 그 다음은 우상, 좌하 순이었다. 판단 기준은 상단 위치에서 양의 값을 보여 보수적(conservative) 판단 경향을 나타냈고, 하단 위치에서는 음의 값을 보여 모험적(liberal) 판단 경향을 보였다. 특히 좌하는 상대적으로 자유로운 판단 기준을 적용하였다(c = -0.1354). 반응편향은 상단 위치에서 보수적 반응 전략(β > 1)을, 하단 위치에서 모험적 반응 전략(β < 1)을 보였다. 특히 우상은 가장 신중한 반응 전략(β = 2.162)을 보였으며, 좌하 보다 자유로운 판단 전략(β = 0.547)을 보였다. 종합적으로, 상단 시야는 높은 민감도와 보수적 판단 기준을 보였고, 하단 시야(좌하)는 낮은 민감도와 모험적 판단 경향을 나타났다.

|

Location |

Sensitivity (d') |

Criterion (c) |

Bias (β) |

|

Top-left |

4.4972 |

+0.0260 |

1.137 |

|

Top-right |

4.2303 |

+0.1484 |

2.162 |

|

Bottom-left |

3.6703 |

-0.1354 |

0.547 |

|

Bottom-right |

∞ |

-∞ |

0 |

본 연구는 차량 HUD에서 정보가 제시되는 주변시야 위치가 운전자의 인지 반응에 미치는 영향을 분석하였다. 이를 위해 각 시야 위치에서의 정확도와 반응시간을 통해 행동적 수행 성능을 평가하고, 인지 효율 지표를 통해 인지 자원 분배의 효율성을 분석하였으며, 신호탐지이론을 활용하여 판단 전략의 특성을 살펴보았다.

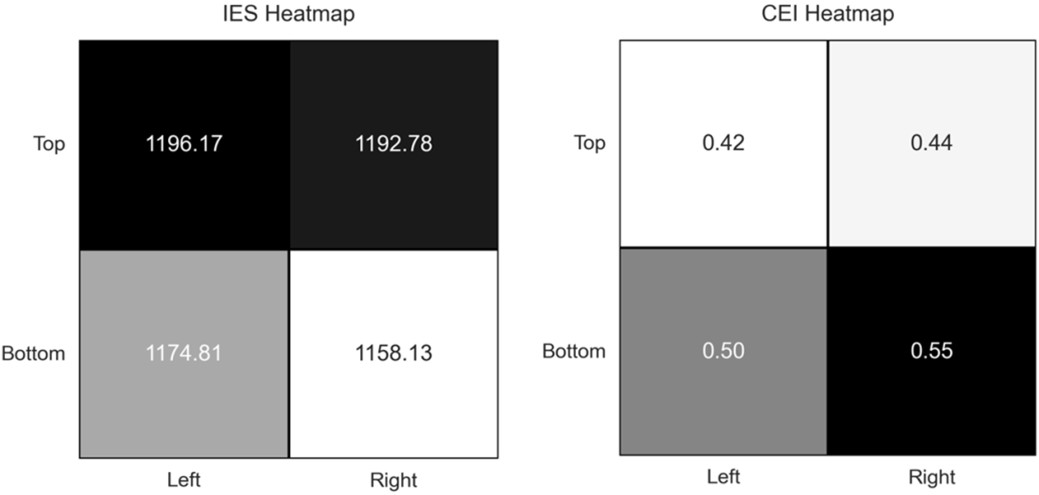

실험을 통한 연구 결과를 보면, 정확도는 하단 시야가 높았으며, 특히 좌하가 가장 높고 우상이 가장 낮았다. 반응시간은 유의한 차이는 없었으나, 전반적으로 하단 시야에서 반응이 빠르고, 우하가 가장 빨랐다. 이러한 결과는 상단 시야가 낮은 정확성과 느린 반응을 보이는 반면, 하단 시야(특히 좌하)는 높은 정확성과 빠른 반응을 보여 하단 위치가 상대적으로 더 효과적인 정보 제시 영역임을 시사한다. 인지 효율 중 CEI만 위치 간 유의한 차이가 나타났고, 효율 수준은 우하–좌하–우상–좌상 순이었다. 스트룹 간섭은 좌하와 우상 위치가 취약했다. 하단 시야는 높은 효율을 보이나, 스트룹 간섭 상황에서는 하단 시야는 취약한 경향을 보여 자극 조건에 따라 인지적 부담 차이가 발생할 가능성을 보인다. 신호탐지이론을 적용한 분석 결과, 상단 시야에서는 높은 민감도와 보수적 판단 경향이 나타나, 시각 자극을 민감하게 구분하되 확신이 있을 때만 반응하여 정확하지만 처리 속도가 느린 특성을 보였다. 반면, 하단 시야에서는 낮은 민감도와 모험적 판단 경향이 관찰되어, 세밀한 구분은 어렵지만 신속한 반응이 가능한 특성을 보였다.

결론적으로 상단 시야는 자극을 신중하게 검증하는 보수적 판단 전략을 보이면서 인지 자원을 제한적으로 분배하는 경향이 있었다. 이로 인해 처리 속도와 인지 효율이 낮았으며, 세밀한 구분을 시도함에도 정확도는 높지 않은 것으로 나타났다. 특히 상단 우측 시야는 상단 좌측보다 더 보수적이고 신중한 판단 전략을 보이며 전반적 효율이 낮았다. 반면 하단 시야는 자극을 빠르게 탐지하고 직관적으로 반응하는 적극적 판단 전략을 보였다. 이러한 전략은 높은 인지 자원 활용을 기반으로 빠른 처리 속도와 높은 인지 효율을 나타냈으며, 빠른 반응에도 불구하고 정확도 역시 높게 유지되었다. 하단 좌측 시야는 정확도가 가장 높았으나 반응 속도와 효율은 우측보다 낮았고, 하단 우측 시야는 무응답 비율이 높아 상대적으로 변동적인 인지 패턴을 보였다.

이러한 결과를 종합하면, 상단 시야는 정보 검증과 판단에 적합한 영역, 하단 시야는 즉각적 반응과 주의 유지에 적합한 영역으로 기능적 구분이 가능하다. 이에 따라 HUD 정보 배치의 인지적 적합성은 좌하–우하–좌상–우상의 순서가 가장 효율적인 것으로 판단된다. 즉, 핵심 정보는 하단 시야, 특히 좌측 영역에 배치하는 것이 가장 유리하다는 점을 시사한다. 다만 본 연구는 18명의 피실험자를 대상으로 한 시뮬레이터 기반 실험으로, 일반화를 위해서는 보다 다양한 피실험자들을 대상으로 실제 도로 환경에서의 실험적 연구를 통한 보완이 필요할 것이다.

References

1. Beck, D. and Park, W., Perceived Importance of Automotive HUD Information Items: a Study with Experienced HUD Users, IEEE Access, 6, 21901-21909, 2018.

Google Scholar

2. Bruyer, R. and Brysbaert, M., Combining speed and accuracy in cognitive psychology: Is the inverse efficiency score (IES) a better dependent variable than the mean reaction time (RT) and the percentage of errors (PE)?, Psychologica Belgica, 51(1), 5-13, 2011.

Google Scholar

3. Christoforou, C., Christou-Champi, C., Constantinidou, F. and Theodorou, M., From the eyes and the heart: a nove leye-gaze metric that predicts video preferences of a large audience, Frontiers in Psychology, 6, 1-11, 2015.

4. Doshi, A., Cheng, S.Y. and Trivedi, M.M., A Novel Active Heads-Up Display for Driver Assistance, IEEE Transactions on Systems, Man, and Cybernetics – Part B: Cybernetics, 39(1), 85-93, 2009.

Google Scholar

5. Enderby, C.M. and Wood, S.T., Head-up display in automobile/aircraft applications, SAE Technical Paper Series No. 920740, Society of Automobile Engineers, New York, 1992.

Google Scholar

6. Endsley, M.R., Toward a theory of situation awareness in dynamic systems, Human Factors: The Journal of the Human Factors and Ergonomics Society, 37(1), 32-64, 1995.

Google Scholar

7. Haines, R.F., Fischer, E. and Price, T.A., Head-up transition behavior of pilots with and without head-up displays in simulated low-visibility approaches, NASA Technical Paper 1720, NASA Ames Research Center, Moffett Field, CA, 1980. https://ntrs.nasa.gov/ citations/19810005124 (retrieved July 23, 2025).

Google Scholar

8. International Organization for Standardization (ISO), ISO 15008:2017 – Road vehicles: Ergonomic aspects of transport information and control systems – Specifications and test procedures for in-vehicle visual presentation, ISO. https://www.iso.org/standard/ 62784.html (retrieved July 23, 2025).

9. Li, J., Zhang, W., Feng, Z., Wei, L., Tang, T. and Gu, T., Effects of Head-Up Display Information Layout Design on Driver Performance: Driving Simulator Studies, International Journal of Human–Computer Interaction, 40(10), 8829-8845, 2024.

Google Scholar

10. Li, R., Chen, Y.V., Zhang, L., Shen, Z. and Qian, Z.C., Effects of perception of head-up display on the driving safety of experienced and inexperienced drivers, Displays, 66, 101962, 2020.

Google Scholar

11. Liesefeld, H.R. and Janczyk, M., Combining speed and accuracy to control for speed–accuracy trade-offs?, Journal of Cognition, 2(1), 1-15, 2019.

Google Scholar

12. Liu, Y.C. and Wen, M.H., Comparison of head-up display (HUD) vs. head-down display (HDD): Driving performance of commercial vehicle operators in Taiwan, International Journal of Human-Computer Studies, 61, 679-697, 2004.

Google Scholar

13. Ma, J., Gong, Z., Tan, J., Zhang, Q. and Zuo, Y., Assessing the driving distraction effect of vehicle HMI displays using data mining techniques, Transportation Research Part F: Traffic Psychology and Behaviour, 69, 235-250, 2020.

Google Scholar

14. McAnany, J.J. and Levine, M.W., Magnocellular and parvocellular visual pathway contributions to visual field anisotropies, Vision Research, 47, 2327-2336, 2007.

Google Scholar

15. Metz, B., Schömig, N. and Krüger, H.P., Attention during visual secondary tasks in driving: Adaptation to the demands of the driving task, Transportation Research Part F: Traffic Psychology and Behaviour, 14, 369-380, 2011.

Google Scholar

16. Nakayama, K. and Mackeben, M., Sustained and transient components of focal visual attention, Vision Research, 29(11), 1631-1647, 1989.

Google Scholar

17. Nielsen Norman Group, F-Shaped Pattern for Reading Web Content, Nielsen Norman Group, https://www.nngroup.com/ rticles/f-shaped-pattern-reading-web-content/?utm_source=chatgpt.com (retrieved July 23, 2025).

18. Park, J. and Park, W., Functional requirements of automotive head-up displays: A systematic review of literature from 1994 to present, Applied Ergonomics, 76, 130-146, 2019.

Google Scholar

19. Pečečnik, K.S., Tomažič, S. and Sodnik, J., Visual Layering of HUD Content in Autonomous Vehicles and its Effects on Driver Performance and Safety, International Journal of Human-Computer Studies, 177, 103060, 2023.

20. Reimer, B., Impact of Cognitive Task Complexity on Drivers' Visual Tunneling, Transportation Research Record: Journal of the Transportation Research Board, 2138(1), 13-19, 2009.

Google Scholar

21. Robinson, A.K., Chern, A., Kahana, M.J. and Gallun, F.J., Exploiting individual differences to assess the role of working memory in speech perception, Physiology & Behavior, 239, 113640, 2021.

22. Rupp, M.A., Gentzler, M.D. and Smither, J.A., Driving under the influence of distraction: Examining dissociations between risk perception and engagement in distracted driving, Accident Analysis & Prevention, 97, 220-229, 2016.

Google Scholar

23. Russell, S.M., Radlbeck, J., Atwood, J., Schaudt, W.A. and McLaughlin, S.B., Head-Up Displays and Distraction Potential, Virginia Tech Transportation Institute, 2023.

Google Scholar

24. Tsimhoni, O., Yoo, H., Watanabe, H., Green, P. and Shah, R., Display of HUD Warning to Drivers: Determining an Optimal Location, University of Michigan Transportation Research Institute / Nissan Research Center, 1999. https://rosap.ntl.bts.gov/view/dot/57527 (retrieved July 23, 2025).

Google Scholar

25. Vater, C., Wolfe, B. and Rosenholtz, R., Peripheral vision in real-world tasks: A systematic review, Psychonomic Bulletin and Review, 29(5), 1531-1557, 2022.

Google Scholar

26. Wickens, C.D., Multiple resources and mental workload, Human Factors, 50(3), 449-455, 2008.

Google Scholar

27. Wickens, C.D., Multiple resources and performance prediction, Theoretical Issues in Ergonomics Science, 3, 159-177, 2002.

Google Scholar

28. Wolfe, J.M., Guided Search 2.0: A revised model of visual search, Psychonomic Bulletin & Review, 1(2), 202-238, 1994.

Google Scholar

29. Yae, J.H., Shin, J.G., Woo, J.H. and Kim, S.H., A Review of Ergonomic Researches for Designing In-Vehicle Information Systems, Journal of the Ergonomics Society of Korea, 36(5), 499-513, 2017.

30. Young, K.L. and Regan, M.A., Driver Distraction: A Review of the Literature, Monash University Accident Research Centre. https://www.monash.edu/__data/assets/pdf_file/0007/217177/Driver-distraction-a-review-of-the-literature.pdf (retrieved July 23, 2025).

PIDS App ServiceClick here!